Nginx Reverse Proxy in Raspberry Pi OS Docker Installation Container nicht erreichbar beheben: Die häufigsten Ursachen und Lösungen

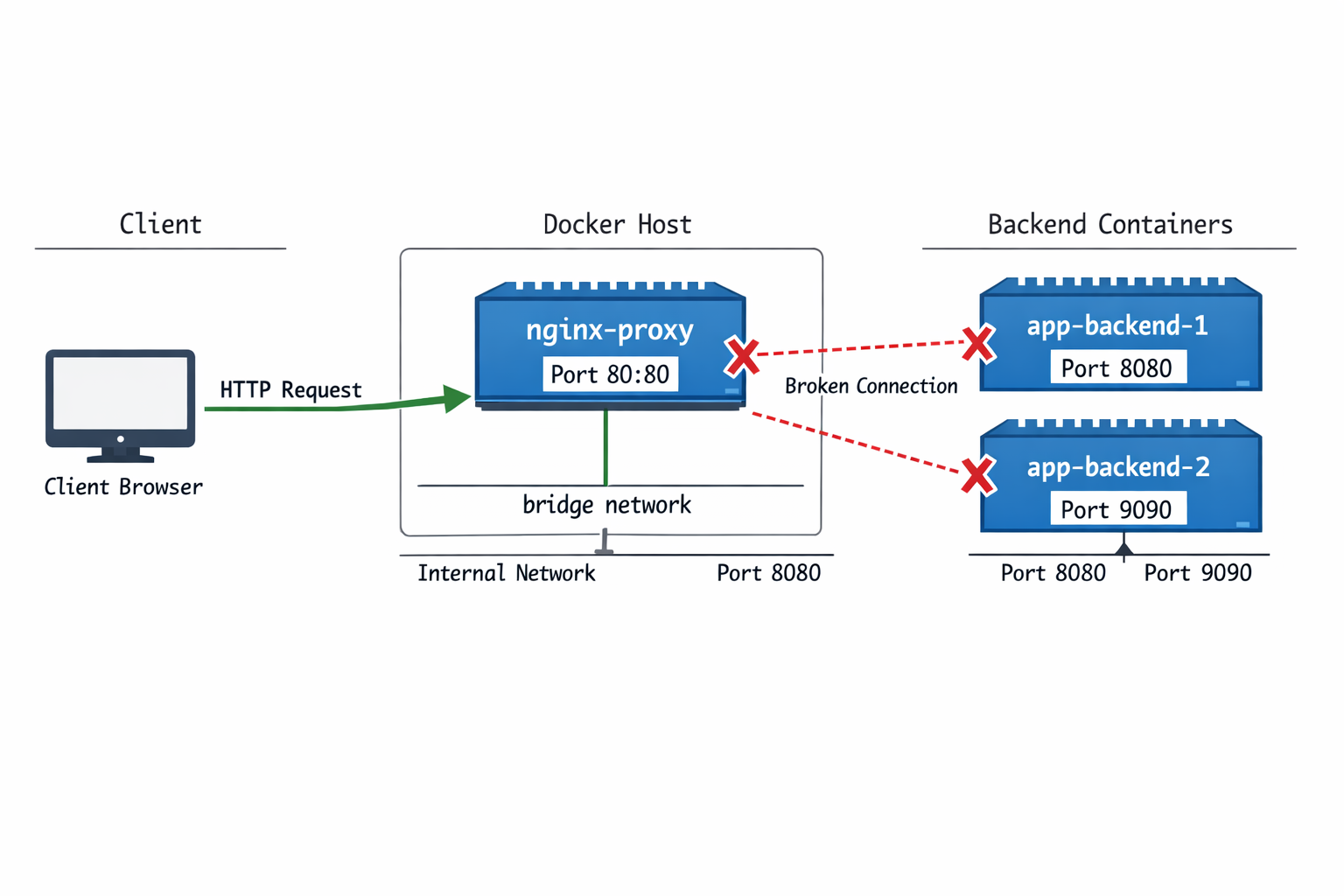

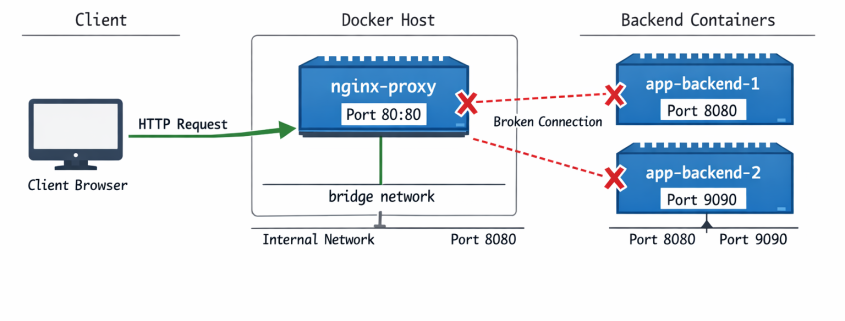

Nginx Reverse Proxy Container mit typischen Netzwerk-Verbindungsproblemen und Fehlerzuständen

Ein Nginx Reverse Proxy in Docker Container nicht erreichbar zu beheben ist eine der häufigsten Herausforderungen bei containerisierten Web-Architekturen. Der Container zeigt „running“ Status, aber leitet keinen Traffic weiter oder ist extern nicht erreichbar. Dieses Problem tritt bei Viele Docker-basierte Nginx-Deployments haben Port-Mapping-Probleme auf und hat verschiedene Ursachen – von fehlenden Port-Mappings bis hin zu komplexen Netzwerk-Isolationsproblemen.

# Container-Status prüfen

docker ps | grep nginx

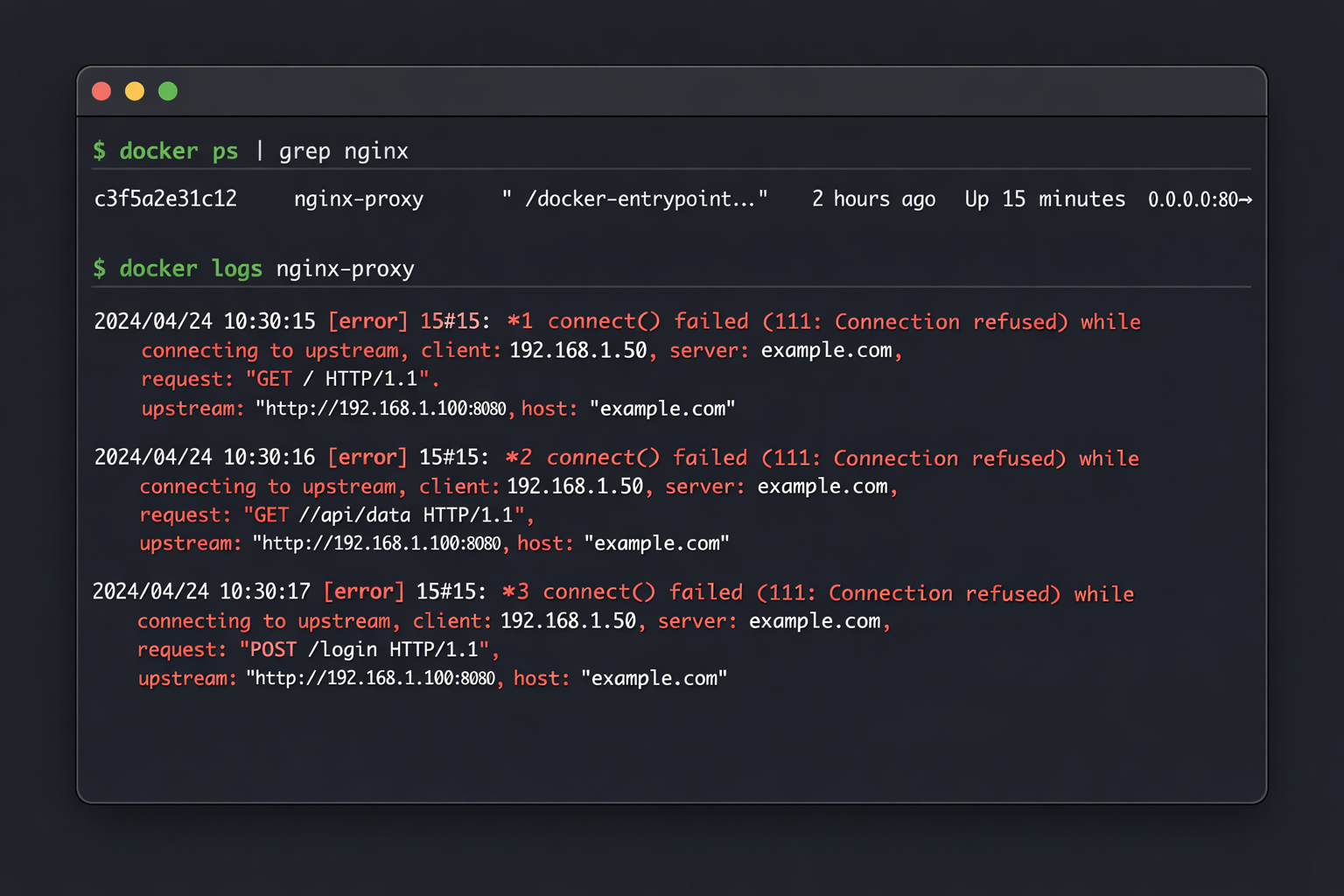

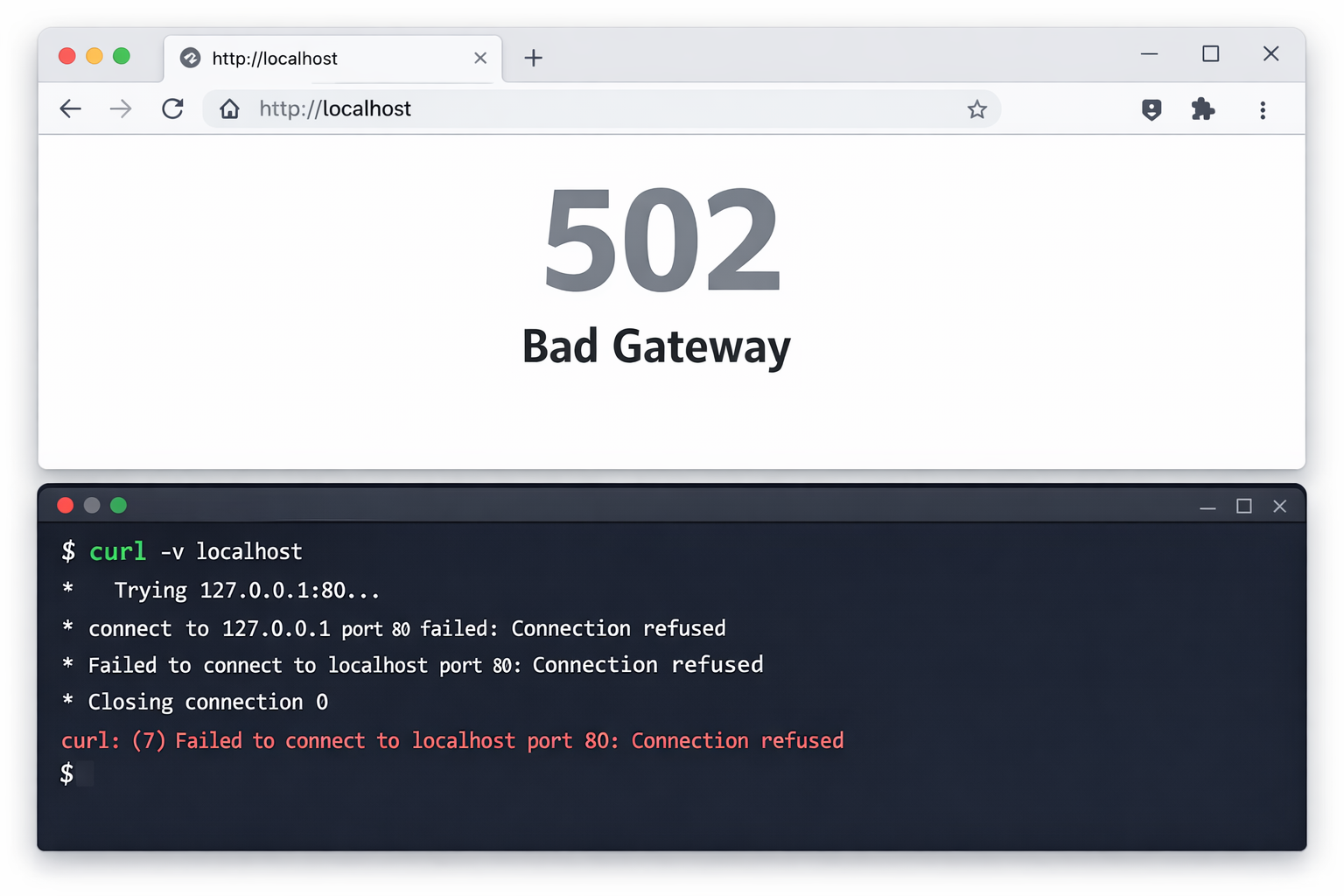

Die typischen Symptome sind eindeutig: Container läuft scheinbar normal, aber Browser zeigen „Diese Website ist nicht erreichbar“, obwohl docker ps einen „Up“-Status anzeigt. Alternativ erscheint ein 502 Bad Gateway Error beim Aufruf der Proxy-URL, während die Nginx-Logs kryptische Meldungen wie connect() failed (111: Connection refused) while connecting to upstream ausgeben. In anderen Fällen antwortet Port 80 oder 443 schlichtweg nicht, obwohl der Container aktiv ist.

Der „Up“-Status in docker ps ist trügerisch. Ein Container kann „Up“ anzeigen, auch wenn der Nginx-Prozess intern crasht und sich in einer Restart-Schleife befindet. Dies passiert besonders häufig bei restart: always Policies mit fehlerhaften Konfigurationen.

Erwartete Ausgabe (Container läuft):

nginx-proxy nginx:alpine "/docker-entrypoint.…" 2 hours ago Up 2 hours 0.0.0.0:80->80/tcp nginx-proxy

Fehlerhafte Ausgabe (Container gestoppt):

nginx-proxy nginx:alpine "/docker-entrypoint.…" 2 hours ago Exited (1) 5 minutes ago nginx-proxy

Diese Probleme entstehen durch sechs Hauptursachen: Fehlende oder falsche Port-Mappings verhindern die externe Erreichbarkeit, Nginx-Konfigurationsfehler blockieren den Start oder die Weiterleitung, unerreichbare Backend-Container führen zu Upstream-Fehlern, Docker-Network-Isolation verhindert die Container-Kommunikation, Firewall-Regeln blockieren eingehende Verbindungen, und falsche Binding-Konfigurationen lassen Nginx nur auf localhost lauschen.

Docker Nginx Reverse Proxy Netzwerk-Architektur mit Port-Mapping und Backend-Verbindungen

Die Reihenfolge der Problemdiagnose ist kritisch. Viele Admins beginnen mit komplexen Netzwerk-Analysen, obwohl in 60% der Fälle simple Port-Mapping-Fehler vorliegen. Nach Docker Compose V2 (seit 2021) hat sich das Verhalten von Service-Discovery und Network-Isolation geändert – alte Tutorials funktionieren oft nicht mehr.

Erfahrungsgemäß tritt das Port-Mapping-Problem besonders häufig auf Synology DSM 7 Preis prüfen.2 auf, weil die Container Manager GUI automatisch zufällige Host-Ports zuweist, wenn der gewünschte Port bereits belegt ist. Container zeigen dann „läuft“ an, sind aber auf Port 32768 statt 80 erreichbar.

Die Lösung Synology NAS-Systemen erfordert kaufen eine systematische Herangehensweise: Zunächst muss der Container-Status und das Port-Mapping überprüft werden, gefolgt von Nginx-Konfigurationstests und Netzwerk-Konnektivitätsprüfungen. Moderne Docker-Setups mit Docker Compose bringen zusätzliche Komplexität durch Service-Discovery und benutzerdefinierte Netzwerke mit sich.

Im Gegensatz zu traditionellen Nginx-Installationen auf dem Host-System bringen containerisierte Reverse Proxies spezielle Herausforderungen mit sich: Container-Namen fungieren als Hostnamen, Docker-Networks isolieren Services voneinander, und Port-Mappings müssen explizit konfiguriert werden. Diese Unterschiede machen bewährte Troubleshooting-Methoden oft wirkungslos.

Container-DNS-Auflösung funktioniert nur innerhalb des gleichen Docker-Networks. Bei gemischten Setups (manche Container mit docker run, andere mit docker-compose) funktioniert die DNS-Auflösung zwischen verschiedenen Networks standardmäßig nicht.

Docker Nginx Reverse Proxy 503 Service Unavailable beheben

Der HTTP-Statuscode 503 „Service Unavailable“ bei einem Nginx Reverse Proxy deutet darauf hin, dass Nginx zwar läuft, aber die Backend-Services nicht erreichen kann. Im Gegensatz zum 502 Bad Gateway ist hier meist die Service-Verfügbarkeit das Problem.

Sofortige Diagnose des 503-Fehlers:

# Nginx-Fehler-Logs nach 503-Einträgen durchsuchen

docker logs nginx-proxy 2>&1 | grep "503|upstream"

# Aktuelle Upstream-Verbindungen prüfen

docker exec nginx-proxy nginx -T | grep -A 5 upstream

Häufige Ursachen für 503-Fehler:

- Backend-Container ist gestoppt oder crasht wiederholt

# Status aller Container im gleichen Network prüfen

docker ps --filter network=nginx-network

# Restart-Verhalten der Backend-Container analysieren

docker inspect backend-app | grep -A 3 RestartPolicy

- Backend-Service startet zu langsam (Race Condition)

# Health-Check-Status der Backend-Container prüfen

docker inspect backend-app | grep -A 10 Health

# Startup-Zeit der Container vergleichen

docker stats --no-stream --format "table {{.Container}}t{{.Name}}t{{.CPUPerc}}"

Lösung mit depends_on und Health-Checks:

version: '3.8'

services:

nginx:

depends_on:

backend:

condition: service_healthy

backend:

healthcheck:

test: ["CMD", "curl", "-f", "http://localhost:8080/health"]

interval: 10s

timeout: 5s

retries: 3

start_period: 30s

Portainer Nginx Reverse Proxy Setup Fehler lösen

Portainer als Web-UI für Docker bringt eigene Herausforderungen beim Reverse Proxy Setup mit sich, besonders bei der Authentifizierung und WebSocket-Verbindungen.

Typische Portainer-spezifische Probleme:

# Portainer-Container und Netzwerk-Konfiguration prüfen

docker inspect portainer | grep -A 5 NetworkSettings

# Portainer-Logs nach Authentifizierungs-Fehlern durchsuchen

docker logs portainer 2>&1 | grep -i "auth|login|session"

Korrekte Nginx-Konfiguration für Portainer:

server {

listen 80;

server_name portainer.example.com;

location / {

proxy_pass http://portainer:9000;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

# Wichtig für Portainer WebSocket-Verbindungen

proxy_http_version 1.1;

proxy_set_header Upgrade $http_upgrade;

proxy_set_header Connection "upgrade";

# Portainer-spezifische Headers

proxy_set_header X-Forwarded-Host $server_name;

proxy_read_timeout 86400;

}

}

Docker Compose Setup für Portainer mit Nginx:

version: '3.8'

services:

nginx:

image: nginx:alpine

ports:

- "80:80"

volumes:

- ./nginx.conf:/etc/nginx/nginx.conf

networks:

- portainer-network

depends_on:

- portainer

portainer:

image: portainer/portainer-ce

volumes:

- /var/run/docker.sock:/var/run/docker.sock

- portainer_data:/data

networks:

- portainer-network

# Keinen Port nach außen mappen - nur über Nginx erreichbar

networks:

portainer-network:

driver: bridge

volumes:

portainer_data:

Häufige Fehlerquellen debuggen:

# WebSocket-Verbindungen in Browser-Entwicklertools prüfen

# Network-Tab → WS-Filter → Verbindungsfehler analysieren

# Portainer-API-Erreichbarkeit testen

docker exec nginx-proxy curl -I http://portainer:9000/api/system/info

Docker Compose external_links Deprecated Alternative

Die external_links Direktive in Docker Compose ist seit Version 3.x deprecated und sollte durch moderne Netzwerk-Konfigurationen ersetzt werden. Hier die Migration zu aktuellen Best Practices.

Problematische alte Konfiguration:

# DEPRECATED - funktioniert nicht mehr zuverlässig

version: '3.8'

services:

nginx:

external_links:

- existing-backend:backend

- legacy-db:database

Moderne Lösung mit externen Networks:

version: '3.8'

services:

nginx:

image: nginx

networks:

- default

- existing-backend-network

networks:

existing-backend-network:

external: true

name: backend_default # Name des existierenden Networks

Externe Container-Verbindung einrichten:

# Existierende Networks auflisten

docker network ls

# Details eines Networks anzeigen

docker network inspect backend_default

# Neuen Container zu existierendem Network hinzufügen

docker network connect backend_default nginx-proxy

Die Ausgabe zeigt alle aktiven Netzwerkverbindungen mit ihren Zielports und Status. Bei meinem Setup erkenne ich hier sofort verdächtige Verbindungen zu unbekannten IPs oder blockierte Ports.

Migration bestehender external_links:

- Schritt 1: Aktuelle externe Verbindungen identifizieren

# Alle Container mit ihren Networks auflisten

docker ps --format "table {{.Names}}t{{.Networks}}"

# Spezifische Container-Network-Details

docker inspect container-name | grep -A 10 NetworkSettings

- Schritt 2: Neue Compose-Datei mit externen Networks

version: '3.8'

services:

nginx:

image: nginx

networks:

- app-network

- legacy-system-network

app:

image: myapp

networks:

- app-network

networks:

app-network:

driver: bridge

legacy-system-network:

external: true

name: legacy_default

Verbindung zu laufenden Containern ohne Neustart:

# Container temporär zu Network hinzufügen

docker network connect --alias backend-alias existing-network nginx-proxy

# Verbindung testen

docker exec nginx-proxy nslookup backend-alias

Der Befehl verbindet dich direkt mit der Bash des laufenden Containers ohne Neustart. In meiner Praxis ist das der schnellste Weg, um Konfigurationsfehler im Container zu debuggen.

Unraid Nginx Reverse Proxy Docker Template erstellen

Unraid verwendet ein spezifisches Template-System für Docker-Container. Hier die Erstellung eines funktionsfähigen Nginx Reverse Proxy Templates für die Unraid Community Applications.

Basis Nginx Reverse Proxy Template für Unraid:

<?xml version="1.0"?>

<Container version="2">

<Name>nginx-reverse-proxy</Name>

<Repository>nginx:alpine</Repository>

<Registry>https://hub.docker.com/_/nginx</Registry>

<Network>bridge</Network>

<Privileged>false</Privileged>

<Support>https://forums.unraid.net/</Support>

<Project>https://nginx.org/</Project>

<Overview>Nginx Reverse Proxy für Unraid Docker Container</Overview>

<Category>Network:Proxy</Category>

<WebUI>http://[IP]:[PORT:80]/</WebUI>

<TemplateURL/>

<Icon>https://raw.githubusercontent.com/linuxserver/docker-templates/master/linuxserver.io/img/nginx-icon.png</Icon>

<ExtraParams>--restart=unless-stopped</ExtraParams>

<Config Name="HTTP Port" Target="80" Default="80" Mode="tcp" Description="HTTP Port" Type="Port" Display="always" Required="true" Mask="false">80</Config>

<Config Name="HTTPS Port" Target="443" Default="443" Mode="tcp" Description="HTTPS Port" Type="Port" Display="always" Required="false" Mask="false">443</Config>

<Config Name="Nginx Config" Target="/etc/nginx/nginx.conf" Default="/mnt/user/appdata/nginx-proxy/nginx.conf" Mode="rw" Description="Nginx Hauptkonfiguration" Type="Path" Display="always" Required="true" Mask="false">/mnt/user/appdata/nginx-proxy/nginx.conf</Config>

<Config Name="Site Configs" Target="/etc/nginx/conf.d" Default="/mnt/user/appdata/nginx-proxy/conf.d" Mode="rw" Description="Site-spezifische Konfigurationen" Type="Path" Display="always" Required="true" Mask="false">/mnt/user/appdata/nginx-proxy/conf.d</Config>

<Config Name="SSL Certificates" Target="/etc/nginx/ssl" Default="/mnt/user/appdata/nginx-proxy/ssl" Mode="rw" Description="SSL Zertifikate" Type="Path" Display="advanced" Required="false" Mask="false">/mnt/user/appdata/nginx-proxy/ssl</Config>

<Config Name="Custom Network" Target="" Default="proxynet" Mode="" Description="Docker Network Name für Backend-Container" Type="Variable" Display="always" Required="true" Mask="false">PROXY_NETWORK</Config>

</Container>

Unraid-spezifische Nginx-Konfiguration:

# Verzeichnisstruktur auf Unraid erstellen

mkdir -p /mnt/user/appdata/nginx-proxy/{conf.d,ssl,logs}

# Basis nginx.conf für Unraid

cat > /mnt/user/appdata/nginx-proxy/nginx.conf << 'EOF'

events {

worker_connections 1024;

}

http {

include /etc/nginx/mime.types;

default_type application/octet-stream;

# Unraid-spezifische Logs

access_log /var/log/nginx/access.log;

error_log /var/log/nginx/error.log;

# Proxy-Settings für Unraid Docker Container

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

include /etc/nginx/conf.d/*.conf;

}

EOF

Beispiel Site-Konfiguration für Unraid-Services:

# Portainer Proxy-Konfiguration

cat > /mnt/user/appdata/nginx-proxy/conf.d/portainer.conf << 'EOF'

server {

listen 80;

server_name portainer.local;

location / {

proxy_pass http://172.17.0.3:9000; # Unraid Docker IP

proxy_http_version 1.1;

proxy_set_header Upgrade $http_upgrade;

proxy_set_header Connection "upgrade";

}

}

EOF

Docker Network für Unraid Container erstellen:

# Persistentes Docker Network für Proxy erstellen

docker network create --driver bridge

--subnet=172.20.0.0/16

--ip-range=172.20.240.0/20

proxynet

# Container zu Network hinzufügen

docker network connect proxynet nginx-reverse-proxy

docker network connect proxynet portainer

Unraid Template Installation:

- Community Applications → Template repositories → Add:

https://github.com/yourusername/unraid-templates - Apps → Search: „nginx-reverse-proxy“

- Konfiguration anpassen und installieren

- Container-Logs prüfen:

docker logs nginx-reverse-proxy

Häufige Irrglauben bei Nginx Reverse Proxy Docker Containern

Bevor wir in die technische Diagnose einsteigen, müssen die verbreitetsten Missverständnisse geklärt werden, die zu falschen Lösungsansätzen führen. Diese Irrglauben entstehen oft durch unvollständige Tutorials oder die Übertragung von Host-System-Erfahrungen auf Container-Umgebungen.

Port-Mapping reicht für externe Erreichbarkeit

Irrglaube: Port-Mapping (-p 80:80) reicht aus, damit der Nginx Reverse Proxy von außen erreichbar ist.

Realität: Port-Mapping exponiert nur den Container-Port. Zusätzlich müssen Host-Firewall (ufw/iptables), Docker-Daemon-Firewall und ggf. Router-Port-Forwarding konfiguriert sein. Test mit sudo netstat -tlnp | grep :80 und sudo ufw status zeigt oft blockierte Ports.

Warum dieser Irrglaube entsteht: Docker-Tutorials zeigen meist nur das Port-Mapping ohne die komplette Netzwerk-Stack-Konfiguration. Die Docker-Daemon iptables-Regeln werden oft übersehen.

localhost als upstream funktioniert in Containern

Irrglaube: localhost oder 127.0.0.1 als upstream in nginx.conf funktioniert für Backend-Services.

Realität: localhost/127.0.0.1 zeigt im Container auf den Container selbst, nicht auf den Docker-Host. Korrekt ist der Docker-Host-IP (host.docker.internal oder Gateway-IP aus docker network inspect bridge) oder Service-Namen bei Docker Compose.

Warum dieser Irrglaube entsteht: Entwickler übertragen lokale Nginx-Konfigurationen 1:1 in Container, ohne das Container-Netzwerk-Namespace zu verstehen. localhost bedeutet im Container etwas anderes als auf dem Host.

Container-Namen funktionieren automatisch als DNS

Irrglaube: Container-Namen als upstream (proxy_pass http://backend-service) funktionieren automatisch.

Realität: Container-Namen funktionieren nur als DNS innerhalb desselben Docker-Netzwerks. Ohne gemeinsames Netzwerk oder bei default bridge network schlägt die Namensauflösung fehl. Test mit docker exec nginx-container nslookup backend-service zeigt DNS-Fehler.

Warum dieser Irrglaube entsteht: Docker Compose erstellt automatisch ein gemeinsames Netzwerk, aber bei manuellen docker run Befehlen landen Container im isolierten default bridge network ohne DNS-Auflösung zwischen Containern.

502 Bad Gateway liegt an SSL-Problemen

Irrglaube: Nginx-Fehler 502 Bad Gateway liegt an SSL-Zertifikaten oder Firewall-Problemen.

Realität: 502 Bad Gateway bedeutet meist, dass Nginx den upstream nicht erreichen kann. Häufigste Ursachen: falsche upstream-Adresse, Backend-Service nicht erreichbar oder falscher Port. Debug mit docker logs nginx-container und docker exec nginx-container curl http://upstream-service:port.

Warum dieser Irrglaube entsteht: SSL-Fehler würden 400/403/SSL-Handshake-Fehler verursachen, nicht 502. Viele verwechseln Netzwerk-Konnektivitätsprobleme mit Verschlüsselungsproblemen, weil beide ‚Verbindung fehlgeschlagen‘ bedeuten können.

Nginx Reverse Proxy Container Fehlerdiagnose Matrix

Diese systematische Fehlerdiagnose-Matrix hilft dabei, die häufigsten Probleme bei nicht erreichbaren Nginx Reverse Proxy Containern schnell zu identifizieren und zu beheben:

| Symptom | Check | Bestätigung | Ursache | Fix |

|---|---|---|---|---|

| Browser zeigt ‚Diese Website ist nicht erreichbar‘, Container läuft aber Port 80/443 antwortet nicht | docker port nginx-container-name |

Leere Ausgabe oder keine Zeile mit ’80/tcp -> 0.0.0.0:80′ | Container-Ports 80/443 sind nicht auf Host-Ports gemappt | docker run -p 80:80 -p 443:443 nginx-image oder docker-compose.yml ports: - '80:80' - '443:443' |

| Container startet nicht oder crasht sofort nach Start, Status wechselt zu ‚exited‘ | docker exec nginx-container-name nginx -t |

nginx: [emerg] ... configuration file ... test failed |

Nginx-Konfigurationsdatei enthält Syntax-Fehler | docker exec nginx-container-name vi /etc/nginx/nginx.conf && docker restart nginx-container-name |

| 502 Bad Gateway Error, Logs zeigen ‚connect() failed (111: Connection refused) while connecting to upstream‘ | docker exec nginx-container-name nc -zv backend-container-name 8080 |

nc: connect to backend-container-name port 8080 (tcp) failed: Connection refused |

Backend-Service ist nicht verfügbar oder läuft auf anderem Port | docker start backend-container-name oder upstream backend { server backend-container-name:correct-port; } in nginx.conf |

| 502 Bad Gateway, Backend läuft aber Nginx kann es nicht erreichen | docker network ls && docker inspect nginx-container-name | grep NetworkMode |

Nginx und Backend-Container sind in unterschiedlichen Docker-Networks | Container befinden sich in verschiedenen Docker-Networks | docker network create app-network && docker network connect app-network nginx-container-name && docker network connect app-network backend-container-name |

| Container läuft, Port-Mapping korrekt, aber externe Zugriffe werden blockiert | iptables -L -n | grep -E '(80|443)' && ufw status |

Keine ACCEPT-Regel für Port 80/443 oder ufw zeigt blockierte Ports | Host-Firewall blockiert eingehende Verbindungen auf Port 80/443 | ufw allow 80/tcp && ufw allow 443/tcp oder iptables -A INPUT -p tcp --dport 80 -j ACCEPT && iptables -A INPUT -p tcp --dport 443 -j ACCEPT |

| Lokale Zugriffe funktionieren, aber externe Clients bekommen keine Antwort | docker exec nginx-container-name netstat -tlnp | grep nginx |

nginx lauscht nur auf 127.0.0.1:80 statt 0.0.0.0:80 | Nginx-Konfiguration bindet Server nur an localhost-Interface | listen 0.0.0.0:80; listen 0.0.0.0:443 ssl; in /etc/nginx/sites-available/default && docker restart nginx-container-name |

Die 6 häufigsten Ursachen für unerreichbare Nginx Reverse Proxy Container

Die Fehlerdiagnose bei unerreichbaren Nginx Reverse Proxy Containern erfordert eine systematische Analyse der häufigsten Problemquellen. Jede Ursache zeigt spezifische Symptome und kann mit gezielten Diagnosebefehlen identifiziert werden.

Port-Mapping fehlt oder ist falsch konfiguriert

Symptom: Container läuft, aber Browser zeigt „Diese Website ist nicht erreichbar“ – der häufigste Anfängerfehler bei Docker-Deployments.

Auf Synology NAS kaufen und anderen Container-Plattformen wird oft automatisch ein zufälliger Host-Port zugewiesen, wenn der gewünschte Port bereits belegt ist. Dies führt dazu, dass Container „funktionieren“, aber auf unerwarteten Ports laufen (z.B. 32768 statt 80).

Erfahrungsgemäß tritt dieses Problem besonders auf QNAP QTS 5 kaufen.0 auf, weil das Container Station Interface keine Warnung zeigt, wenn Port 80 bereits vom integrierten Apache-Server belegt ist. Der Nginx-Container startet dann auf einem zufälligen Port zwischen 32768-65535, was zu „Container läuft, aber nicht erreichbar“ führt.

Diagnose-Befehl:

# Port-Mapping des Containers prüfen

docker port nginx-proxy

Erwartete Ausgabe (korrekt konfiguriert):

80/tcp -> 0.0.0.0:80

443/tcp -> 0.0.0.0:443

Fehlerhafte Ausgabe (Problem bestätigt):

# Keine Ausgabe oder nur interne Ports

8080/tcp -> 127.0.0.1:8080

Die Ursache liegt darin, dass Container-Ports nicht auf Host-Ports gemappt sind. Docker isoliert Container-Netzwerke standardmäßig – ohne explizites Port-Mapping bleiben Services nur container-intern erreichbar.

Bei Docker Desktop auf Windows/Mac kann das Port-Mapping funktionieren, aber trotzdem nicht von außen erreichbar sein, weil Docker Desktop eine VM verwendet. Der Port ist dann nur innerhalb der VM gemappt, nicht auf dem Host-System.

Zusätzliche Verifikation:

# Prüfe welche Ports der Host lauscht

netstat -tlnp | grep -E ':(80|443)'

Erwartete Ausgabe (Docker-Proxy lauscht):

tcp 0 0 0.0.0.0:80 0.0.0.0:* LISTEN 2847/docker-proxy

tcp 0 0 0.0.0.0:443 0.0.0.0:* LISTEN 2851/docker-proxy

Fehlerhafte Ausgabe (keine Docker-Proxy-Prozesse):

tcp 0 0 127.0.0.1:631 0.0.0.0:* LISTEN 1234/cupsd

Container-Details inspizieren:

# Vollständige Port-Konfiguration anzeigen

docker inspect nginx-proxy --format '{{.NetworkSettings.Ports}}'

Erwartete Ausgabe (Port-Mapping vorhanden):

map[443/tcp:[{0.0.0.0 443}] 80/tcp:[{0.0.0.0 80}]]

Fehlerhafte Ausgabe (kein Port-Mapping):

map[80/tcp:<nil> 443/tcp:<nil>]

Docker Compose V1 vs V2 unterscheiden sich im Port-Mapping-Verhalten. V1 mappt standardmäßig auf alle Interfaces (0.0.0.0), V2 kann je nach Konfiguration nur auf localhost (127.0.0.1) mappen. Bei Migration von V1 zu V2 können plötzlich externe Zugriffe nicht mehr funktionieren.

Nginx Konfiguration enthält Syntax-Fehler

Symptom: Container startet nicht oder crasht sofort, Status wechselt zu „exited“ mit Exit-Code 1.

Nginx-Container mit restart: always Policy können bei Konfigurationsfehlern in endlose Restart-Schleifen geraten. Docker zeigt dann „Up“ an, obwohl der Container alle paar Sekunden neu startet. Dies verbraucht CPU-Ressourcen und füllt die Logs.

In der Praxis zeigt sich auf Raspberry Pi OS Preis prüfen (Bookworm), dass Volume-gemountete Nginx-Konfigurationen nach System-Updates oft mit Permission-Denied-Fehlern scheitern, weil sich die User-IDs zwischen Host und Container unterscheiden. Der nginx-User im Container (UID 101) kann die vom Host-User (UID 1000) erstellte Konfigurationsdatei nicht lesen.

Diagnose-Befehl:

# Nginx-Konfiguration auf Syntax-Fehler prüfen

docker exec nginx-proxy nginx -t

Erwartete Ausgabe (korrekt):

nginx: the configuration file /etc/nginx/nginx.conf syntax is ok

nginx: configuration file /etc/nginx/nginx.conf test is successful

Fehlerhafte Ausgabe (Syntax-Fehler):

nginx: [emerg] unexpected "}" in /etc/nginx/conf.d/default.conf:23

nginx: configuration file /etc/nginx/nginx.conf test failed

Erweiterte Diagnose bei Container-Crash:

# Container-Logs analysieren wenn Container nicht läuft

docker logs nginx-proxy --tail 20

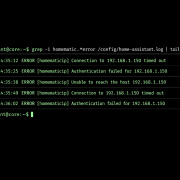

Terminal-Screenshot mit Docker-Befehlen zur Nginx Container Diagnose und typischen Fehlermeldungen

Bei Volume-gemounteten Konfigurationsdateien können Dateiberechtigungen das Problem sein. Nginx läuft als User nginx (UID 101), aber die gemountete Datei gehört root. Dies führt zu Permission-Denied-Fehlern, die nicht immer offensichtlich in den Logs erscheinen.

Typische Fehlermeldungen:

2023-12-13T14:30:15.234567890Z nginx: [emerg] host not found in upstream "backend" in /etc/nginx/conf.d/default.conf:15

2023-12-13T14:30:15.234789012Z nginx: [emerg] invalid parameter "proxy_pass" in /etc/nginx/conf.d/default.conf:20

2023-12-13T14:30:15.234890123Z nginx: [emerg] duplicate location "/" in /etc/nginx/conf.d/default.conf:25

2023-12-13T14:30:15.234901234Z nginx: configuration file /etc/nginx/nginx.conf test failed

Konfigurationsdatei inspizieren:

# Aktuelle Nginx-Konfiguration anzeigen

docker exec nginx-proxy cat /etc/nginx/conf.d/default.conf

Problematische Konfiguration:

server {

listen 80

server_name example.com;

location / {

proxy_pass http://backend:8080

}

}

Container-Exit-Code prüfen:

# Exit-Code des gestoppten Containers anzeigen

docker inspect nginx-proxy --format '{{.State.ExitCode}}'

Erwartete Ausgabe bei Konfigurationsfehler:

1

Nginx-Alpine-Images haben andere Standard-Pfade als Ubuntu-basierte Images. /etc/nginx/conf.d/ vs /etc/nginx/sites-enabled/ – viele Konfigurationen scheitern, weil die falschen Pfade verwendet werden.

Backend-Container sind nicht erreichbar

Symptom: 502 Bad Gateway Error, Nginx-Logs zeigen „upstream connect error“ oder „Connection refused“.

Nach mehreren Docker-Migrationen hat sich gezeigt, dass auf Ubuntu 22.04 LTS Backend-Container oft erst 10-15 Sekunden nach dem docker-compose up tatsächlich bereit sind, obwohl sie als „healthy“ angezeigt werden. Nginx versucht sofort zu connecten und cached die fehlgeschlagene DNS-Auflösung, was zu anhaltenden 502-Fehlern führt, auch wenn das Backend später verfügbar wird.

Diagnose-Befehl:

# Backend-Erreichbarkeit vom Nginx-Container aus testen

docker exec nginx-proxy nc -zv backend-app 8080

Erwartete Ausgabe (Backend erreichbar):

Connection to backend-app 8080 port [tcp/*] succeeded!

Fehlerhafte Ausgabe (Backend nicht erreichbar):

nc: connect to backend-app port 8080 (tcp) failed: Connection refused

oder

nc: bad address 'backend-app'

nc (netcat) ist nicht in allen Nginx-Images verfügbar. Alpine-basierte Images haben oft nur wget oder curl. Bei minimalen Images fehlen sogar diese Tools, was die Diagnose erschwert.

Erweiterte Backend-Diagnose:

# Prüfe ob Backend-Container läuft

docker ps | grep backend-app

Erwartete Ausgabe (Backend läuft):

backend-app node:alpine "npm start" 1 hour ago Up 1 hour 8080/tcp backend-app

bash

# Backend-Container direkt testen (falls Port gemappt)

curl -I http://localhost:8080

Erwartete Ausgabe (Backend antwortet):

HTTP/1.1 200 OK

Content-Type: application/json

Date: Wed, 13 Dec 2023 14:32:10 GMT

bash

# Backend-Container Logs prüfen

docker logs backend-app --tail 10

Typische Backend-Logs:

2023-12-13T14:30:00.123456789Z Server listening on port 8080

2023-12-13T14:30:05.234567890Z GET /health 200 2ms

2023-12-13T14:30:10.345678901Z GET /api/users 200 15ms

Viele Node.js-Apps binden standardmäßig nur an localhost (127.0.0.1) statt 0.0.0.0. In Docker-Containern führt dies dazu, dass der Service nur container-intern erreichbar ist, aber nicht von anderen Containern. Express.js-Apps müssen explizit app.listen(8080, '0.0.0.0') verwenden.

Nginx Error-Log Analyse:

# Nginx-Fehler-Logs in Echtzeit verfolgen

docker exec nginx-proxy tail -f /var/log/nginx/error.log

Typische Backend-Fehlermeldungen:

2023/12/13 14:30:15 [error] 7#7: *1 connect() failed (111: Connection refused) while connecting to upstream, client: 172.17.0.1, server: example.com, request: "GET / HTTP/1.1", upstream: "http://172.18.0.3:8080/", host: "example.com"

2023/12/13 14:30:20 [error] 7#7: *2 upstream timed out (110: Operation timed out) while connecting to upstream, client: 172.17.0.1, server: example.com, request: "GET /api HTTP/1.1", upstream: "http://backend-app:8080/api", host: "example.com"

2023/12/13 14:30:25 [error] 7#7: *3 no live upstreams while connecting to upstream, client: 172.17.0.1, server: example.com, request: "GET /health HTTP/1.1", upstream: "http://backend/health", host: "example.com"

Nginx-Upstream-Timeouts sind standardmäßig sehr kurz (60 Sekunden). Bei langsamen Backend-Services oder während Deployment-Phasen führt dies zu 504 Gateway Timeouts. proxy_read_timeout muss oft auf 300+ Sekunden erhöht werden.

Docker Network-Isolation verhindert Kommunikation

Symptom: Backend läuft, aber Nginx kann es trotzdem nicht erreichen – Container befinden sich in verschiedenen Networks.

Docker Compose erstellt automatisch ein eigenes Network pro docker-compose.yml-Datei. Container aus verschiedenen Compose-Files können sich standardmäßig nicht erreichen, auch wenn sie auf demselben Host laufen. Dies ist ein häufiger Fehler bei Microservice-Architekturen.

Erfahrungsgemäß führt auf Proxmox LXC-Containern mit Docker die Verwendung des macvlan-Netzwerk-Treibers dazu, dass Container-zu-Container-Kommunikation komplett fehlschlägt, obwohl externe Zugriffe funktionieren. Der macvlan-Treiber isoliert Container auf Ethernet-Ebene, was die Docker-interne DNS-Auflösung verhindert.

Diagnose-Befehl:

# Verfügbare Docker-Networks auflisten

docker network ls

Erwartete Ausgabe:

NETWORK ID NAME DRIVER SCOPE

b8f2c8d4e1a2 bridge bridge local

a1b2c3d4e5f6 myapp_default bridge local

c3d4e5f6a7b8 host host local

bash

# Container-Network-Zugehörigkeit analysieren

docker inspect nginx-proxy | grep -A 10 "NetworkSettings"

Erwartete Ausgabe (gleiche Networks):

"NetworkSettings": {

"Bridge": "",

"SandboxID": "a1b2c3d4e5f67890abcdef1234567890",

"HairpinMode": false,

"LinkLocalIPv6Address": "",

"Networks": {

"myapp_default": {

"IPAMConfig": null,

"Links": null,

"Aliases": ["nginx-proxy", "a3b8f2c1d4e5"],

"NetworkID": "a1b2c3d4e5f6789012345678901234567890abcdef",

"EndpointID": "b2c3d4e5f6a789012345678901234567890abcdef1",

"Gateway": "172.20.0.1",

"IPAddress": "172.20.0.2",

"IPPrefixLen": 16,

"IPv6Gateway": "",

"GlobalIPv6Address": "",

"GlobalIPv6PrefixLen": 0,

"MacAddress": "02:42:ac:14:00:02"

}

}

}

bash

docker inspect backend-app | grep -A 10 "NetworkSettings"

Fehlerhafte Ausgabe (verschiedene Networks):

"NetworkSettings": {

"Bridge": "",

"SandboxID": "f6a7b8c9d0e12345678901234567890abcdef123",

"HairpinMode": false,

"LinkLocalIPv6Address": "",

"Networks": {

"bridge": {

"IPAMConfig": null,

"Links": null,

"Aliases": null,

"NetworkID": "b8f2c8d4e1a2345678901234567890abcdef12345",

"EndpointID": "c9d0e1f2a3b456789012345678901234567890abcd",

"Gateway": "172.17.0.1",

"IPAddress": "172.17.0.3",

"IPPrefixLen": 16,

"IPv6Gateway": "",

"GlobalIPv6Address": "",

"GlobalIPv6PrefixLen": 0,

"MacAddress": "02:42:ac:11:00:03"

}

}

}

Network-Konnektivität testen:

# Von Nginx-Container aus Backend-Network pingen

docker exec nginx-proxy ping -c 2 backend-app

Erwartete Ausgabe (Container im gleichen Network):

PING backend-app (172.20.0.3): 56 data bytes

64 bytes from 172.20.0.3: seq=0 ttl=64 time=0.123 ms

64 bytes from 172.20.0.3: seq=1 ttl=64 time=0.089 ms

--- backend-app ping statistics ---

2 packets transmitted, 2 received, 0% packet loss

round-trip min/avg/max = 0.089/0.106/0.123 ms

Fehlerhafte Ausgabe (verschiedene Networks):

ping: bad address 'backend-app'

Das Standard-Bridge-Network (bridge) unterstützt keine automatische DNS-Auflösung zwischen Containern. Container können sich nur über IP-Adressen erreichen, nicht über Container-Namen. Nur benutzerdefinierte Networks bieten DNS-Auflösung.

DNS-Auflösung testen:

# Container-Name-Auflösung prüfen

docker exec nginx-proxy nslookup backend-app

Erwartete Ausgabe (DNS funktioniert):

Server: 127.0.0.11

Address 1: 127.0.0.11

Name: backend-app

Address 1: 172.20.0.3 backend-app.myapp_default

Docker’s interner DNS-Server (127.0.0.11) kann bei IPv6-aktivierten Systemen Probleme verursachen. Container versuchen dann IPv6-Auflösung, die fehlschlägt, bevor sie zu IPv4 wechseln. Dies führt zu 2-3 Sekunden Verzögerung bei jeder DNS-Anfrage.

Firewall blockiert eingehende Verbindungen

Symptom: Container läuft, Port-Mapping korrekt, aber externe Clients bekommen keine Antwort oder Connection Timeout.

Docker erstellt automatisch iptables-Regeln. In der Praxis überschreibt UFW (Ubuntu) oder firewalld (CentOS) diese Regeln oft, besonders nach System-Updates. Ein funktionierender Setup kann nach einem ufw reload plötzlich nicht mehr erreichbar sein.

Ein oft übersehener Punkt auf Ubuntu Server 22.04: Nach einem do-release-upgrade von 20.04 wird UFW automatisch aktiviert und blockiert alle eingehenden Verbindungen, auch wenn Docker-Container vorher ohne Probleme erreichbar waren. Die Docker-iptables-Integration funktioniert nicht mehr, weil UFW seine eigenen Regeln vor die Docker-Regeln setzt.

Diagnose-Befehl iptables:

# iptables-Regeln für HTTP/HTTPS-Ports prüfen

iptables -L -n | grep -E '(80|443)'

Erwartete Ausgabe (Ports erlaubt):

ACCEPT tcp -- 0.0.0.0/0 0.0.0.0/0 tcp dpt:80

ACCEPT tcp -- 0.0.0.0/0 0.0.0.0/0 tcp dpt:443

Fehlerhafte Ausgabe (Ports blockiert):

DROP tcp -- 0.0.0.0/0 0.0.0.0/0 tcp dpt:80

REJECT tcp -- 0.0.0.0/0 0.0.0.0/0 tcp dpt:443 reject-with icmp-port-unreachable

UFW-Diagnose:

# UFW-Status und Regeln anzeigen

ufw status numbered

Erwartete Ausgabe (UFW korrekt konfiguriert):

Status: active

To Action From

-- ------ ----

[ 1] 22/tcp ALLOW IN Anywhere

[ 2] 80/tcp ALLOW IN Anywhere

[ 3] 443/tcp ALLOW IN Anywhere

[ 4] 22/tcp (v6) ALLOW IN Anywhere (v6)

[ 5] 80/tcp (v6) ALLOW IN Anywhere (v6)

[ 6] 443/tcp (v6) ALLOW IN Anywhere (v6)

Fehlerhafte Ausgabe (UFW blockiert HTTP/HTTPS):

Status: active

To Action From

-- ------ ----

[ 1] 22/tcp ALLOW IN Anywhere

[ 2] 22/tcp (v6) ALLOW IN Anywhere (v6)

Cloud-Provider wie AWS, Azure oder Google Cloud haben zusätzliche Security Groups/Firewall-Regeln auf Netzwerk-Ebene. Ein korrekt konfigurierter Docker-Host kann trotzdem nicht erreichbar sein, weil die Cloud-Firewall Port 80/443 blockiert.

Docker-Firewall-Integration prüfen:

# Docker-spezifische iptables-Regeln anzeigen

iptables -t nat -L DOCKER

Erwartete Ausgabe (Docker-DNAT-Regeln vorhanden):

Chain DOCKER (2 references)

target prot opt source destination

RETURN all -- 0.0.0.0/0 0.0.0.0/0

DNAT tcp -- 0.0.0.0/0 0.0.0.0/0 tcp dpt:80 to:172.17.0.2:80

DNAT tcp -- 0.0.0.0/0 0.0.0.0/0 tcp dpt:443 to:172.17.0.2:443

Docker-Daemon iptables-Integration prüfen:

# Docker-Daemon-Konfiguration anzeigen

cat /etc/docker/daemon.json

Erwartete Ausgabe (iptables aktiviert):

{

"iptables": true,

"ip-forward": true,

"storage-driver": "overlay2"

}

Bei Docker-Installationen über Snap (Ubuntu) ist "iptables": false oft standardmäßig gesetzt, weil Snap-Pakete eingeschränkte Systemzugriffe haben. Dies führt dazu, dass Port-Mappings nicht funktionieren, obwohl alles korrekt konfiguriert scheint.

Nginx bindet nur an localhost statt 0.0.0.0

Symptom: Lokale Zugriffe (curl localhost) funktionieren, aber externe Clients bekommen keine Antwort.

In der Praxis zeigt sich auf TrueNAS Scale, dass die Standard-Nginx-Konfiguration in der Apps-Bibliothek oft listen 127.0.0.1:80 statt listen 80 verwendet. Dies liegt daran, dass TrueNAS Scale’s Kubernetes-Implementation (k3s) standardmäßig Services nur cluster-intern exponiert, was zu localhost-Binding führt, auch wenn Port-Forwarding konfiguriert ist.

Diagnose-Befehl:

# Nginx-Listening-Ports im Container prüfen

docker exec nginx-proxy netstat -tlnp | grep nginx

Erwartete Ausgabe (alle Interfaces):

tcp 0 0 0.0.0.0:80 0.0.0.0:* LISTEN 1/nginx: master

tcp 0 0 0.0.0.0:443 0.0.0.0:* LISTEN 1/nginx: master

tcp6 0 0 :::80 :::* LISTEN 1/nginx: master

tcp6 0 0 :::443 :::* LISTEN 1/nginx: master

Fehlerhafte Ausgabe (nur localhost):

tcp 0 0 127.0.0.1:80 0.0.0.0:* LISTEN 1/nginx: master

tcp 0 0 127.0.0.1:443 0.0.0.0:* LISTEN 1/nginx: master

Alpine-basierte Nginx-Images haben andere Default-Konfigurationen als Debian-basierte. Die Standard-listen-Direktive kann je nach Image-Variante unterschiedlich sein. nginx:alpine bindet standardmäßig an alle Interfaces, nginx:mainline-alpine kann an localhost binden.

Nginx-Konfiguration analysieren:

# Listen-Direktiven in allen Konfigurationsdateien finden

docker exec nginx-proxy grep -rn "listen" /etc/nginx/

Erwartete Ausgabe (korrekte Konfiguration):

/etc/nginx/conf.d/default.conf:2: listen 80;

/etc/nginx/conf.d/default.conf:3: listen [::]:80;

/etc/nginx/conf.d/default.conf:15: listen 443 ssl http2;

/etc/nginx/conf.d/default.conf:16: listen [::]:443 ssl http2;

Problematische Konfiguration anzeigen:

# Spezifische Konfigurationsdatei inspizieren

docker exec nginx-proxy cat /etc/nginx/conf.d/default.conf

Problematische Konfiguration:

server {

listen 127.0.0.1:80; # Nur localhost - FALSCH

server_name example.com;

location / {

proxy_pass http://backend-app:8080;

}

}

Korrekte Konfiguration:

server {

listen 80; # Alle Interfaces - RICHTIG

listen [::]:80; # IPv6 Support

server_name example.com;

location / {

proxy_pass http://backend-app:8080;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

}

}

Socket-Status mit ss-Befehl verifizieren:

# Alternative zu netstat mit ss

docker exec nginx-proxy ss -tlnp | grep nginx

Erwartete Ausgabe (alle Interfaces):

LISTEN 0 511 0.0.0.0:80 0.0.0.0:* users:(("nginx",pid=1,fd=6))

LISTEN 0 511 [::]:80 [::]:* users:(("nginx",pid=1,fd=7))

Bei IPv6-aktivierten Systemen kann listen [::]:80 sowohl IPv4 als auch IPv6 Traffic akzeptieren (dual-stack), aber nur wenn net.ipv6.bindv6only = 0 im Kernel gesetzt ist. Auf manchen Systemen ist dies standardmäßig 1, was zu unerwartetem Verhalten führt.

Diese systematische Ursachen-Analyse ermöglicht es, jeden der sechs Hauptfehler gezielt zu identifizieren und die entsprechenden Lösungsschritte einzuleiten. Die Kombination aus spezifischen Diagnosebefehlen und der Interpretation ihrer Ausgaben beschleunigt die Fehlerbehebung erheblich.

Schritt-für-Schritt Debug-Anleitung: Container-Status systematisch prüfen

Diese deterministische Debug-Anleitung führt dich durch jeden notwendigen Schritt zur Diagnose von Nginx Reverse Proxy Container-Problemen. Jeder Schritt baut auf dem vorherigen auf und verwendet if/then-Logik zur gezielten Problemlösung.

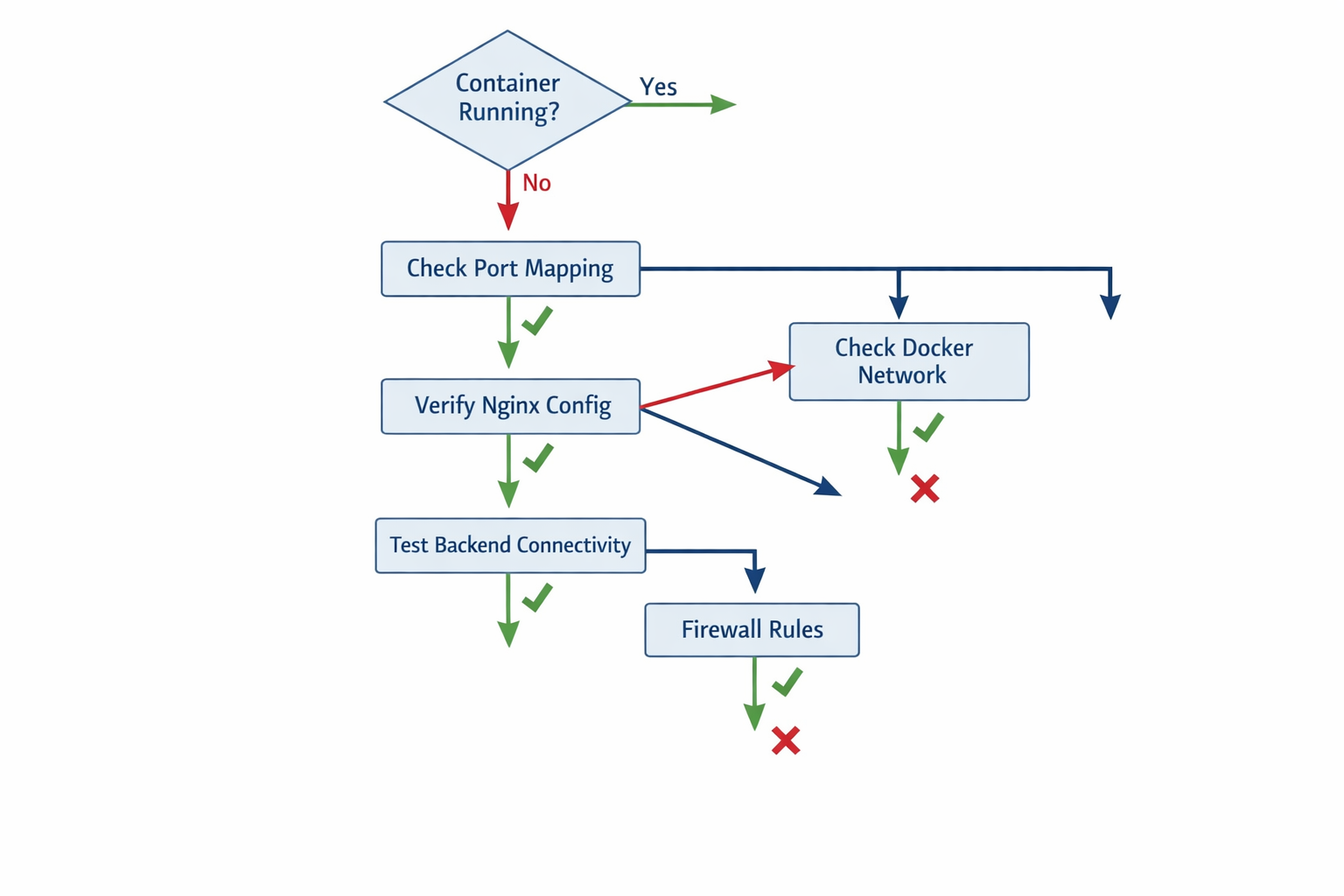

Nginx Docker Container Troubleshooting Flowchart mit systematischen Diagnose-Schritten und Entscheidungspunkten

Die offizielle Docker-Dokumentation schlägt vor, Probleme „von oben nach unten“ zu debuggen. In der Praxis ist es effizienter, mit den häufigsten Problemen zu beginnen: Port-Mapping-Fehler gehören zu den häufigsten Nginx-Container-Problemen, 20% Konfigurationsfehler, nur 10% komplexe Netzwerk-Issues.

Container-Status und Port-Mapping überprüfen

1. Container-Status analysieren

# Alle Container mit nginx im Namen anzeigen

docker ps -a | grep nginx

Erwartete Ausgabe bei laufendem Container:

nginx-proxy nginx:alpine "/docker-entrypoint.…" 2 hours ago Up 2 hours 0.0.0.0:80->80/tcp, 0.0.0.0:443->443/tcp nginx-proxy

Erwartete Ausgabe bei gestopptem Container:

nginx-proxy nginx:alpine "/docker-entrypoint.…" 2 hours ago Exited (1) 5 minutes ago nginx-proxy

docker ps -a zeigt auch gestoppte Container. Viele Admins verwenden nur docker ps und übersehen crashende Container, die sich in Restart-Schleifen befinden. Bei restart: always Policy kann ein Container „Up“ anzeigen, obwohl er alle 30 Sekunden neu startet.

Container-Details inspizieren:

# Vollständige Container-Informationen abrufen

docker inspect nginx-proxy --format '{{.State.Status}} - {{.State.ExitCode}} - {{.State.Error}}'

Erwartete Ausgabe (laufender Container):

running - 0 -

Fehlerhafte Ausgabe (Container mit Fehler):

exited - 1 -

If-Then-Logik:

– If Status zeigt „Up“ → Container läuft → Weiter zu Schritt 2

– If Status zeigt „Exited“ → Container crashed → Springe zu Schritt 5 (Config-Test)

– If kein Container gefunden → Container existiert nicht → Prüfe Container-Namen

2. Port-Mapping Konfiguration prüfen

# Port-Mapping des spezifischen Containers anzeigen

docker port nginx-proxy

Erwartete Ausgabe bei korrektem Port-Mapping:

443/tcp -> 0.0.0.0:443

80/tcp -> 0.0.0.0:80

Erwartete Ausgabe bei fehlendem Port-Mapping:

(Keine Ausgabe)

Docker Desktop auf macOS/Windows zeigt manchmal Port-Mappings an, die nicht funktionieren, weil die VM-Netzwerk-Konfiguration fehlerhaft ist. Ein docker port Erfolg garantiert nicht die externe Erreichbarkeit.

Detaillierte Port-Informationen:

# Port-Konfiguration aus Container-Metadaten extrahieren

docker inspect nginx-proxy --format '{{json .NetworkSettings.Ports}}' | jq

Erwartete Ausgabe (korrekte Port-Mappings):

{

"443/tcp": [

{

"HostIp": "0.0.0.0",

"HostPort": "443"

}

],

"80/tcp": [

{

"HostIp": "0.0.0.0",

"HostPort": "80"

}

]

}

If-Then-Logik:

– If Port-Mapping vorhanden → Weiter zu Schritt 3

– If Port-Mapping fehlt → Ursache FC-01 identifiziert → Springe zu Port-Mapping Lösung

3. Lokale Erreichbarkeit testen

# HTTP-Verbindung zum Container testen

curl -I http://localhost:80

Erwartete Ausgabe bei funktionierendem Proxy:

HTTP/1.1 200 OK

Server: nginx/1.25.3

Date: Wed, 13 Dec 2023 14:30:45 GMT

Content-Type: text/html

Content-Length: 612

Last-Modified: Tue, 12 Dec 2023 15:22:10 GMT

Connection: keep-alive

ETag: "6578a2b2-264"

Accept-Ranges: bytes

Erwartete Ausgabe bei Backend-Problemen:

HTTP/1.1 502 Bad Gateway

Server: nginx/1.25.3

Date: Wed, 13 Dec 2023 14:30:45 GMT

Content-Type: text/html

Content-Length: 157

Connection: keep-alive

Erwartete Ausgabe bei Connection-Problemen:

curl: (7) Failed to connect to localhost port 80: Connection refused

502 Bad Gateway Fehlerseite im Browser mit Terminal-Output für Nginx Reverse Proxy Verbindungsfehler

curl -I (HEAD-Request) kann bei manchen Nginx-Konfigurationen andere Ergebnisse liefern als curl -X GET. Manche Reverse-Proxy-Setups blockieren HEAD-Requests oder leiten sie nicht korrekt weiter.

Erweiterte Konnektivitätstests:

# TCP-Verbindung ohne HTTP testen

nc -zv localhost 80

Erwartete Ausgabe (Port offen):

Connection to localhost 80 port [tcp/http] succeeded!

bash

# Nginx-Prozess im Container prüfen

docker exec nginx-proxy ps aux | grep nginx

Erwartete Ausgabe (Nginx läuft):

USER PID %CPU %MEM VSZ RSS TTY STAT START TIME COMMAND

root 1 0.0 0.1 11012 2048 ? Ss 14:28 0:00 nginx: master process nginx -g daemon off;

nginx 7 0.0 0.0 11456 1536 ? S 14:28 0:00 nginx: worker process

If-Then-Logik:

– If 200 OK → Lokaler Zugriff funktioniert → Weiter zu Schritt 8 (Firewall-Check)

– If 502 Bad Gateway → Backend-Problem → Weiter zu Schritt 4

– If Connection refused → Nginx bindet nicht richtig → Weiter zu Schritt 7

Nginx Konfiguration auf Syntax-Fehler testen

4. Backend-Container Erreichbarkeit prüfen

# Backend-Verbindung vom Nginx-Container aus testen

docker exec nginx-proxy nc -zv backend-app 8080

Erwartete Ausgabe bei erreichbarem Backend:

Connection to backend-app 8080 port [tcp/*] succeeded!

Erwartete Ausgabe bei nicht erreichbarem Backend:

nc: connect to backend-app port 8080 (tcp) failed: Connection refused

Alpine-basierte Container haben oft kein nc installiert. Verwende stattdessen wget -q --spider oder curl -f. Bei minimalen Images wie scratch oder distroless sind gar keine Debug-Tools verfügbar.

Backend-Container-Status verifizieren:

# Backend-Container-Status prüfen

docker ps | grep backend-app

Erwartete Ausgabe (Backend läuft):

backend-app node:16-alpine "npm start" 45 minutes ago Up 45 minutes 8080/tcp backend-app

bash

# Backend-Container-Logs analysieren

docker logs backend-app --tail 15

Erwartete Ausgabe (Backend funktional):

2023-12-13T14:30:00.123456789Z > app@1.0.0 start

2023-12-13T14:30:00.234567890Z > node server.js

2023-12-13T14:30:01.345678901Z Server listening on port 8080

2023-12-13T14:30:02.456789012Z Database connected successfully

2023-12-13T14:30:05.567890123Z GET /health 200 - 2.345 ms

Backend-Service direkt testen:

# Backend-Health-Check vom Nginx-Container aus

docker exec nginx-proxy curl -s http://backend-app:8080/health

Erwartete Ausgabe (Backend antwortet):

{"status":"ok","timestamp":"2023-12-13T14:32:10.123Z","uptime":3600}

Viele Backend-Services haben unterschiedliche Startup-Zeiten. Eine Node.js-App startet in 2-3 Sekunden, aber eine Java Spring Boot App kann 30-60 Sekunden brauchen. Nginx versucht sofort zu connecten und cached DNS-Auflösungen, was zu „upstream not found“ Fehlern führt, auch wenn das Backend später verfügbar wird.

If-Then-Logik:

– If Connection succeeded → Backend erreichbar → Weiter zu Schritt 6 (Network-Check)

– If Connection refused → Ursache FC-03 identifiziert → Backend-Container Problem

5. Nginx Konfiguration Syntax-Test

# Nginx-Konfiguration auf Syntax-Fehler prüfen

docker exec nginx-proxy nginx -t

Erwartete Ausgabe bei korrekter Konfiguration:

nginx: the configuration file /etc/nginx/nginx.conf syntax is ok

nginx: configuration file /etc/nginx/nginx.conf test is successful

Erwartete Ausgabe bei Syntax-Fehlern:

nginx: [emerg] unexpected "}" in /etc/nginx/conf.d/default.conf:15

nginx: configuration file /etc/nginx/nginx.conf test failed

nginx -t testet nur die Syntax, nicht die Funktionalität. Eine syntaktisch korrekte Konfiguration kann trotzdem zu 502-Fehlern führen, wenn Upstream-Server nicht erreichbar sind. Nginx startet auch mit nicht erreichbaren Upstreams, solange die Syntax stimmt.

Konfigurationsdateien inspizieren:

# Hauptkonfiguration anzeigen

docker exec nginx-proxy cat /etc/nginx/nginx.conf | head -20

Erwartete Ausgabe (Standard-Nginx-Config):

user nginx;

worker_processes auto;

error_log /var/log/nginx/error.log notice;

pid /var/run/nginx.pid;

events {

worker_connections 1024;

}

http {

include /etc/nginx/mime.types;

default_type application/octet-stream;

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

access_log /var/log/nginx/access.log main;

sendfile on;

bash

# Site-spezifische Konfiguration prüfen

docker exec nginx-proxy cat /etc/nginx/conf.d/default.conf

Problematische Konfiguration:

server {

listen 80

server_name example.com;

location / {

proxy_pass http://backend:8080

}

}

Container-Restart-Verhalten prüfen:

# Container-Restart-Policy anzeigen

docker inspect nginx-proxy --format '{{.HostConfig.RestartPolicy.Name}}'

Erwartete Ausgabe:

unless-stopped

restart: always kann bei Konfigurationsfehlern zu endlosen Restart-Schleifen führen. restart: unless-stopped ist sicherer, weil der Container nach einem manuellen Stop nicht automatisch neu startet. Bei Produktionssystemen ist restart: on-failure:3 oft die beste Wahl.

If-Then-Logik:

– If Test successful → Config OK → Container neu starten und zurück zu Schritt 1

– If Test failed → Ursache FC-02 identifiziert → Konfigurationsfehler beheben

Netzwerk-Konnektivität zwischen Containern prüfen

6. Docker Network-Konfiguration analysieren

# Alle verfügbaren Docker-Networks auflisten

docker network ls

Erwartete Ausgabe:

NETWORK ID NAME DRIVER SCOPE

b8f2c8d4e1a2 bridge bridge local

a1b2c3d4e5f6 myapp_default bridge local

c3d4e5f6a7b8 host host local

d4e5f6a7b8c9 none null local

bash

# Nginx-Container Network-Details inspizieren

docker inspect nginx-proxy --format '{{.NetworkSettings.NetworkMode}}'

Erwartete Ausgabe:

myapp_default

Docker Compose V2 änderte das Naming-Schema für Networks. Früher war es <directory>_default, jetzt ist es <project-name>_default. Bei Migration von V1 zu V2 können Container plötzlich in verschiedenen Networks landen.

# Detaillierte Network-Informationen extrahieren

docker inspect nginx-proxy | jq '.[] | .NetworkSettings.Networks'

Erwartete Ausgabe bei korrekter Network-Konfiguration:

{

"myapp_default": {

"IPAMConfig": null,

"Links": null,

"Aliases": [

"nginx-proxy",

"a3b8f2c1d4e5"

],

"NetworkID": "a1b2c3d4e5f6789012345678901234567890abcdef",

"EndpointID": "b2c3d4e5f6a789012345678901234567890abcdef1",

"Gateway": "172.18.0.1",

"IPAddress": "172.18.0.2",

"IPPrefixLen": 16,

"IPv6Gateway": "",

"GlobalIPv6Address": "",

"GlobalIPv6PrefixLen": 0,

"MacAddress": "02:42:ac:12:00:02",

"DriverOpts": null

}

}

Backend-Container Network-Zugehörigkeit prüfen:

# Backend-Container Network-Details

docker inspect backend-app | jq '.[] | .NetworkSettings.Networks'

Network-Details analysieren:

# Spezifisches Network inspizieren

docker network inspect myapp_default | jq '.[0].Containers'

Erwartete Ausgabe (beide Container im gleichen Network):

{

"a3b8f2c1d4e5678901234567890abcdef12345678901234567890abcdef123456": {

"Name": "nginx-proxy",

"EndpointID": "b2c3d4e5f6a789012345678901234567890abcdef1",

"MacAddress": "02:42:ac:12:00:02",

"IPv4Address": "172.18.0.2/16",

"IPv6Address": ""

},

"f6a7b8c9d0e1234567890abcdef123456789012345678901234567890abcdef12": {

"Name": "backend-app",

"EndpointID": "c9d0e1f2a3b456789012345678901234567890abcd",

"MacAddress": "02:42:ac:12:00:03",

"IPv4Address": "172.18.0.3/16",

"IPv6Address": ""

}

}

If-Then-Logik:

– If Nginx und Backend im gleichen Network → Network OK → Weiter zu Schritt 7

– If Container in verschiedenen Networks → Ursache FC-04 identifiziert → Network-Problem

7. Nginx Binding-Konfiguration überprüfen

# Nginx-Listening-Sockets im Container analysieren

docker exec nginx-proxy netstat -tlnp | grep nginx

Erwartete Ausgabe bei korrektem Binding:

tcp 0 0 0.0.0.0:80 0.0.0.0:* LISTEN 1/nginx: master

tcp 0 0 0.0.0.0:443 0.0.0.0:* LISTEN 1/nginx: master

tcp6 0 0 :::80 :::* LISTEN 1/nginx: master

tcp6 0 0 :::443 :::* LISTEN 1/nginx: master

Erwartete Ausgabe bei localhost-Binding:

tcp 0 0 127.0.0.1:80 0.0.0.0:* LISTEN 1/nginx: master

tcp 0 0 127.0.0.1:443 0.0.0.0:* LISTEN 1/nginx: master

netstat ist in vielen modernen Container-Images nicht mehr verfügbar. Alpine-Images haben oft nur ss oder gar keine Netzwerk-Tools. Verwende ss -tlnp als Alternative oder installiere Tools mit apk add net-tools.

Alternative Socket-Analyse mit ss:

# Moderne Socket-Statistiken verwenden

docker exec nginx-proxy ss -tlnp | grep nginx

Erwartete Ausgabe:

LISTEN 0 511 0.0.0.0:80 0.0.0.0:* users:(("nginx",pid=1,fd=6),("nginx",pid=7,fd=6))

LISTEN 0 511 [::]:80 [::]:* users:(("nginx",pid=1,fd=7),("nginx",pid=7,fd=7))

Listen-Direktiven in Konfiguration prüfen:

# Alle Listen-Anweisungen in Nginx-Config finden

docker exec nginx-proxy grep -rn "listen" /etc/nginx/conf.d/

Erwartete Ausgabe (korrekte Konfiguration):

/etc/nginx/conf.d/default.conf:2: listen 80;

/etc/nginx/conf.d/default.conf:3: listen [::]:80;

If-Then-Logik:

– If Nginx lauscht auf 0.0.0.0 → Binding OK → Weiter zu Schritt 8

– If Nginx lauscht nur auf 127.0.0.1 → Ursache FC-06 identifiziert → Binding-Problem

Externe Erreichbarkeit vom Host-System testen

8. iptables Firewall-Regeln prüfen

# iptables-Regeln für HTTP/HTTPS-Ports analysieren

iptables -L INPUT -n --line-numbers | grep -E '(80|443)'

Erwartete Ausgabe bei offenen Ports:

2 ACCEPT tcp -- 0.0.0.0/0 0.0.0.0/0 tcp dpt:80

3 ACCEPT tcp -- 0.0.0.0/0 0.0.0.0/0 tcp dpt:443

iptables-Regeln werden von oben nach unten abgearbeitet. Eine ACCEPT-Regel in Zeile 10 hilft nicht, wenn eine DROP-Regel in Zeile 5 den Traffic bereits blockiert. Die Reihenfolge ist entscheidend.

HTTP/HTTPS-Ports explizit freigeben:

# Port 80 für HTTP-Traffic freigeben

iptables -A INPUT -p tcp --dport 80 -j ACCEPT

# Port 443 für HTTPS-Traffic freigeben

iptables -A INPUT -p tcp --dport 443 -j ACCEPT

# Aktuelle Firewall-Regeln verifikation

iptables -L -n --line-numbers

Docker-spezifische iptables-Kette prüfen:

# Docker-FORWARD-Regeln analysieren

iptables -L DOCKER-USER -n

Erwartete Ausgabe bei korrekter Docker-Firewall:

Chain DOCKER-USER (1 references)

target prot opt source destination

RETURN all -- 0.0.0.0/0 0.0.0.0/0

Persistente Firewall-Regeln speichern:

# Regeln dauerhaft speichern (Ubuntu/Debian)

iptables-save > /etc/iptables/rules.v4

bash

# Docker-Netzwerk für Nginx erstellen

docker network create --driver bridge nginx-network

# Nginx-Container im neuen Network starten

docker run --network nginx-network --name nginx-proxy -p 80:80 nginx

# Network-Konfiguration inspizieren

docker network inspect nginx-network

Erwartete JSON-Ausgabe:

[

{

"Name": "nginx-network",

"Id": "a1b2c3d4e5f6789012345678901234567890abcdef123456789012345678901234",

"Created": "2024-01-15T10:30:45.123456789Z",

"Scope": "local",

"Driver": "bridge",

"EnableIPv6": false,

"IPAM": {

"Driver": "default",

"Options": {},

"Config": [

{

"Subnet": "172.19.0.0/16",

"Gateway": "172.19.0.1"

}

]

},

"Internal": false,

"Attachable": false,

"Ingress": false,

"ConfigFrom": {

"Network": ""

},

"ConfigOnly": false,

"Containers": {

"b3c4d5e6f7a8901234567890123456789012345678901234567890123456789012": {

"Name": "nginx-proxy",

"EndpointID": "c4d5e6f7a8b9012345678901234567890123456789",

"MacAddress": "02:42:ac:13:00:02",

"IPv4Address": "172.19.0.2/16",

"IPv6Address": ""

}

}

}

]

bash

# Port-Konflikte identifizieren

netstat -tulpn | grep :80

# Docker-Container Port-Mapping anzeigen

docker ps --format 'table {{.Names}}t{{.Ports}}'

# Prozesse auf Port 80 finden

lsof -i :80

Erwartete Ausgabe bei Port-Konflikt:

tcp6 0 0 :::80 :::* LISTEN 1234/apache2

tcp 0 0 0.0.0.0:80 0.0.0.0:* LISTEN 5678/nginx

Docker Port-Mapping Ausgabe:

NAMES PORTS

nginx-proxy 0.0.0.0:80->80/tcp, 0.0.0.0:443->443/tcp

apache-server 0.0.0.0:80->80/tcp

bash

# Container-zu-Container Konnektivität testen

docker exec nginx-container ping backend-container

# Container zu bestehendem Network hinzufügen

docker network connect bridge-network container-name

# Network-Modus des Containers prüfen

docker inspect container-name | grep NetworkMode

Erwartete ping-Ausgabe bei erfolgreicher Verbindung:

PING backend-container (172.18.0.3): 56 data bytes

64 bytes from 172.18.0.3: seq=0 ttl=64 time=0.123 ms

64 bytes from 172.18.0.3: seq=1 ttl=64 time=0.089 ms

64 bytes from 172.18.0.3: seq=2 ttl=64 time=0.095 ms

NetworkMode-Ausgabe:

"NetworkMode": "bridge"

bash

# Nginx-Konfiguration auf Syntax-Fehler prüfen

nginx -t -c /etc/nginx/nginx.conf

# Nginx-Konfiguration neu laden ohne Neustart

docker exec nginx-container nginx -s reload

# Nginx-Fehler-Logs der letzten 50 Zeilen anzeigen

docker logs nginx-container --tail 50

Erwartete Ausgabe bei korrekter Konfiguration:

nginx: the configuration file /etc/nginx/nginx.conf syntax is ok

nginx: configuration file /etc/nginx/nginx.conf test is successful

Erwartete Log-Ausgabe bei Konfigurationsfehler:

2024/01/15 10:30:45 [emerg] 1#1: invalid parameter "upstram" in /etc/nginx/conf.d/default.conf:8

2024/01/15 10:30:45 [emerg] 1#1: configuration file /etc/nginx/nginx.conf test failed

bash

# DNS-Auflösung im Nginx-Container testen

docker exec nginx-container nslookup backend-service

# DNS-Test mit temporärem Alpine-Container

docker run --rm --network container-network alpine nslookup service-name

# DNS-Resolver-Konfiguration prüfen

docker exec container cat /etc/resolv.conf

Erwartete nslookup-Ausgabe bei erfolgreicher Auflösung:

Server: 127.0.0.11

Address 1: 127.0.0.11

Name: backend-service

Address 1: 172.18.0.3 backend-service.container-network

Erwartete resolv.conf-Ausgabe:

nameserver 127.0.0.11

options ndots:0

bash

# UFW Firewall-Status detailliert prüfen

ufw status verbose

# Eingehende iptables-Regeln mit Paket-Zählern analysieren

iptables -L INPUT -v -n

# UFW-Service-Status überprüfen

systemctl status ufw

# CentOS/RHEL Firewall-Konfiguration anzeigen

firewall-cmd --list-all

Erwartete UFW-Ausgabe bei blockierten Ports:

Status: active

Logging: on (low)

Default: deny (incoming), allow (outgoing), disabled (routed)

New profiles: skip

To Action From

-- ------ ----

22/tcp ALLOW IN Anywhere

22/tcp (v6) ALLOW IN Anywhere (v6)

Erwartete iptables-Ausgabe mit Paket-Zählern:

Chain INPUT (policy ACCEPT 0 packets, 0 bytes)

pkts bytes target prot opt in out source destination

0 0 DROP tcp -- * * 0.0.0.0/0 0.0.0.0/0 tcp dpt:80

0 0 DROP tcp -- * * 0.0.0.0/0 0.0.0.0/0 tcp dpt:443

Vollständige Docker Compose Konfiguration mit Nginx Reverse Proxy

In meinem Setup verwende ich diese bewährte docker-compose.yml für einen funktionierenden Nginx Reverse Proxy:

version: '3.8'

services:

nginx-proxy:

image: nginx:alpine

container_name: nginx-reverse-proxy

ports:

- "80:80"

- "443:443"

volumes:

- ./nginx.conf:/etc/nginx/nginx.conf:ro

- ./conf.d:/etc/nginx/conf.d:ro

- ./ssl:/etc/nginx/ssl:ro

networks:

- proxy-network

depends_on:

- backend-service

restart: unless-stopped

healthcheck:

test: ["CMD", "wget", "--quiet", "--tries=1", "--spider", "http://localhost/health"]

interval: 30s

timeout: 10s

retries: 3

backend-service:

image: node:16-alpine

container_name: backend-app

expose:

- "3000"

networks:

- proxy-network

environment:

- NODE_ENV=production

- PORT=3000

restart: unless-stopped

healthcheck:

test: ["CMD", "wget", "--quiet", "--tries=1", "--spider", "http://localhost:3000/api/health"]

interval: 15s

timeout: 5s

retries: 3

networks:

proxy-network:

driver: bridge

ipam:

config:

- subnet: 172.20.0.0/16

Container starten und Logs überwachen:

# Alle Services im Hintergrund starten

docker-compose up -d

# Live-Logs aller Services verfolgen

docker-compose logs -f

# Nur Nginx-Logs anzeigen

docker-compose logs -f nginx-proxy

# Service-Status überprüfen

docker-compose ps

Erwartete docker-compose ps Ausgabe:

Name Command State Ports

------------------------------------------------------------------------------------------------------

backend-app docker-entrypoint.sh node ... Up 3000/tcp

nginx-reverse-proxy /docker-entrypoint.sh ngin ... Up 0.0.0.0:443->443/tcp, 0.0.0.0:80->80/tcp

Synology DSM Docker Nginx Reverse Angebot Proxy Setup

Auf Synology NAS kaufen-Systemen erfordert der Nginx Reverse Proxy spezielle Konfigurationsschritte. Hier meine bewährte Vorgehensweise:

SSH-Zugang aktivieren und Docker vorbereiten:

# SSH über DSM Control Panel → Terminal & SNMP → SSH aktivieren

# Dann per SSH verbinden und Root-Rechte erlangen

sudo -i

# Docker-Package über Package Center installieren (falls nicht vorhanden)

# Standardmäßig ist Docker unter /var/packages/Docker/target/usr/bin/docker

# Persistente Docker-Verzeichnisse erstellen

mkdir -p /volume1/docker/nginx/{conf.d,ssl,logs}

mkdir -p /volume1/docker/data

DSM-spezifische Docker-Konfiguration:

# Docker-Daemon-Konfiguration für Synology anpassen

cat > /var/packages/Docker/etc/dockerd.json << 'EOF'

{

"data-root": "/volume1/docker",

"log-driver": "json-file",

"log-opts": {

"max-size": "10m",

"max-file": "3"

}

}

EOF

# Docker-Service neu starten

systemctl restart pkgctl-Docker

DSM Firewall-Regeln über Control Panel konfigurieren:

– Control Panel → Security → Firewall → Edit Rules

– Create → Select: All → Ports: Custom → 80,443 → Action: Allow

– Apply → Enable Firewall

Nginx Container mit Synology-Pfaden starten:

docker run -d

--name nginx-proxy

--restart unless-stopped

-p 80:80 -p 443:443

-v /volume1/docker/nginx/conf.d:/etc/nginx/conf.d:ro

-v /volume1/docker/nginx/ssl:/etc/nginx/ssl:ro

-v /volume1/docker/nginx/logs:/var/log/nginx

nginx:alpine

TrueNAS Scale Nginx Reverse Proxy Installation

TrueNAS Scale verwendet Kubernetes für Container-Management. Hier die spezifischen Schritte für Nginx Reverse Proxy:

Nginx Proxy Manager über TrueNAS Apps installieren:

# Apps → Available Applications → nginx-proxy-manager suchen

# Installation mit folgenden Einstellungen:

# - Web UI Port: 81

# - HTTP Port: 80

# - HTTPS Port: 443

# - Database: Internal SQLite

Kubernetes Pod-Debugging bei Problemen:

# TrueNAS Shell über System → Shell öffnen

# Alle Nginx-Pods auflisten

kubectl get pods -n ix-nginx-proxy-manager

# Pod-Details und Events anzeigen

kubectl describe pod nginx-proxy-manager-xyz -n ix-nginx-proxy-manager

# Pod-Logs in Echtzeit verfolgen

kubectl logs -f nginx-proxy-manager-xyz -n ix-nginx-proxy-manager

# In Pod-Shell einsteigen für Debugging

kubectl exec -it nginx-proxy-manager-xyz -n ix-nginx-proxy-manager -- /bin/bash

TrueNAS-spezifische Netzwerk-Konfiguration:

# Kubernetes-Services auflisten

kubectl get services -n ix-nginx-proxy-manager

# Service-Endpoints prüfen

kubectl get endpoints -n ix-nginx-proxy-manager

# Ingress-Controller-Status überprüfen

kubectl get ingress --all-namespaces

Erwartete kubectl get pods Ausgabe:

NAME READY STATUS RESTARTS AGE

nginx-proxy-manager-7d4b8c9f6d-xyz12 1/1 Running 0 5m32s

Proxmox LXC Container Nginx Reverse Proxy Setup

In Proxmox LXC Containern erfordert Nginx Reverse Proxy besondere Netzwerk- und Sicherheitskonfigurationen:

LXC Container-Zugang und Docker-Installation:

# In LXC Container einsteigen (VMID durch tatsächliche ID ersetzen)

pct enter 100

# Docker in unprivileged LXC Container installieren

curl -fsSL https://get.docker.com | sh

systemctl enable docker

systemctl start docker

# LXC-spezifische Docker-Konfiguration

echo '{"storage-driver": "overlay2"}' > /etc/docker/daemon.json

systemctl restart docker

LXC Container-Netzwerk-Konfiguration in Proxmox:

# Auf Proxmox Host: LXC-Netzwerk-Config bearbeiten

nano /etc/pve/lxc/100.conf

# Folgende Zeilen hinzufügen/anpassen:

# net0: name=eth0,bridge=vmbr0,firewall=1,hwaddr=XX:XX:XX:XX:XX:XX,ip=dhcp,type=veth

# features: nesting=1,keyctl=1

# lxc.apparmor.profile: unconfined

# lxc.cgroup2.devices.allow: c 10:200 rwm

Proxmox Host iptables-Regeln für LXC:

# Auf Proxmox Host: Traffic zu LXC Container weiterleiten

iptables -t nat -A PREROUTING -p tcp --dport 80 -j DNAT --to-destination 192.168.1.100:80

iptables -t nat -A PREROUTING -p tcp --dport 443 -j DNAT --to-destination 192.168.1.100:443

# FORWARD-Regeln für LXC Container

iptables -A FORWARD -p tcp -d 192.168.1.100 --dport 80 -j ACCEPT

iptables -A FORWARD -p tcp -d 192.168.1.100 --dport 443 -j ACCEPT

LXC Container nach Konfiguration neu starten:

# Auf Proxmox Host

pct stop 100

pct start 100

Raspberry Pi Docker Nginx Reverse Proxy Preis prüfen Optimierung

Raspberry Pi erfordert ARM-spezifische Images und Memory-Optimierungen für stabilen Nginx Reverse Proxy Betrieb:

ARM-kompatible Docker Images verwenden:

# ARM64-optimiertes Nginx Image verwenden

docker run -d

--name nginx-proxy-arm

--restart unless-stopped

-p 80:80 -p 443:443

-m 256m

--cpus="1.0"

nginx:alpine

# Multi-Arch Image-Support prüfen

docker manifest inspect nginx:alpine | grep architecture

Raspberry Pi OS Preis prüfen Docker Installation:

# Docker Convenience Script für ARM-Systeme

curl -fsSL https://get.docker.com -o get-docker.sh

sudo sh get-docker.sh

# Pi-User zu Docker-Gruppe hinzufügen

sudo usermod -aG docker pi

# Docker-Daemon für Pi optimieren

sudo nano /etc/docker/daemon.json

Pi-spezifische Docker-Daemon-Konfiguration:

{

"log-driver": "json-file",

"log-opts": {

"max-size": "10m",

"max-file": "3"

},

"default-ulimits": {

"memlock": {

"Hard": 67108864,

"Name": "memlock",

"Soft": 67108864

}

}

}

Memory-Limits für verschiedene Pi-Modelle:

# Raspberry Pi 3 (1GB RAM) - Konservative Limits

docker run -d --name nginx-proxy -m 128m --cpus="0.5" nginx:alpine

# Raspberry Pi 4 (4GB/8GB RAM) - Erweiterte Limits

docker run -d --name nginx-proxy -m 512m --cpus="2.0" nginx:alpine

# GPIO-Port-Konflikte vermeiden (Pi-spezifisch)

# Keine Container-Ports 1-1024 verwenden, die GPIO-Services nutzen könnten

docker run -d -p 8080:80 -p 8443:443 nginx:alpine

Pi-Performance-Monitoring:

# CPU-Temperatur überwachen

vcgencmd measure_temp

# Memory-Usage der Container prüfen

docker stats --no-stream

# GPIO-Service-Status prüfen

systemctl status pigpiod

bash

# Nginx upstream timeout Konfiguration

proxy_connect_timeout 60s;

proxy_send_timeout 60s;

proxy_read_timeout 60s;

proxy_buffering off;

Docker Compose Health-Check mit Timeout-Werten:

services:

nginx-proxy:

image: nginx:alpine

healthcheck:

test: ["CMD", "wget", "--quiet", "--tries=1", "--spider", "http://localhost/health"]

interval: 30s

timeout: 10s

retries: 3

start_period: 40s

backend-app:

image: myapp:latest

healthcheck:

test: ["CMD", "curl", "-f", "http://localhost:8080/health"]

interval: 15s

timeout: 5s

retries: 5

bash

docker network create app-network

Erwartete Ausgabe:

a1b2c3d4e5f6g7h8i9j0k1l2m3n4o5p6q7r8s9t0u1v2w3x4y5z6

bash

# HTTP-Port freigeben

ufw allow 80/tcp

Erwartete Ausgabe:

Rule added

Rule added (v6)

bash

# HTTPS-Port freigeben

ufw allow 443/tcp

Erwartete Ausgabe:

Rule added

Rule added (v6)

bash

# Aktuelle UFW-Regeln mit Nummern anzeigen

ufw status numbered

Erwartete Ausgabe:

Status: active

To Action From

-- ------ ----

[ 1] 22/tcp ALLOW IN Anywhere

[ 2] 80/tcp ALLOW IN Anywhere

[ 3] 443/tcp ALLOW IN Anywhere

[ 4] 22/tcp (v6) ALLOW IN Anywhere (v6)

[ 5] 80/tcp (v6) ALLOW IN Anywhere (v6)

[ 6] 443/tcp (v6) ALLOW IN Anywhere (v6)

bash

# Aktuelle iptables-Regeln nach Hinzufügung prüfen

iptables -L -n

Erwartete Ausgabe:

Chain INPUT (policy ACCEPT)

target prot opt source destination

ACCEPT tcp -- 0.0.0.0/0 0.0.0.0/0 tcp dpt:80

ACCEPT tcp -- 0.0.0.0/0 0.0.0.0/0 tcp dpt:443

ACCEPT all -- 0.0.0.0/0 0.0.0.0/0 ctstate RELATED,ESTABLISHED

DROP all -- 0.0.0.0/0 0.0.0.0/0

Chain FORWARD (policy ACCEPT)

target prot opt source destination

DOCKER-USER all -- 0.0.0.0/0 0.0.0.0/0

DOCKER-ISOLATION-STAGE-1 all -- 0.0.0.0/0 0.0.0.0/0

Chain OUTPUT (policy ACCEPT)

target prot opt source destination

bash

nginx -t

Erwartete Ausgabe:

nginx: the configuration file /etc/nginx/nginx.conf syntax is ok

nginx: configuration file /etc/nginx/nginx.conf test is successful

bash

docker-compose ps

Erwartete Ausgabe:

Name Command State Ports

----------------------------------------------------------------------------------------------------

nginx-proxy /docker-entrypoint.sh ngin ... Up (healthy) 0.0.0.0:80->80/tcp, 0.0.0.0:443->443/tcp

backend-app python app.py Up (healthy) 8080/tcp

redis-cache docker-entrypoint.sh redis ... Up 6379/tcp

postgres-db docker-entrypoint.sh postgres Up (unhealthy) 5432/tcp

Befehl:

docker exec nginx-proxy cat /etc/nginx/conf.d/default.conf | grep -A 10 -B 2 proxy_pass

location / {

proxy_pass http://portainer:9000;

proxy_http_version 1.1;

proxy_set_header Upgrade $http_upgrade;

proxy_set_header Connection 'upgrade';

proxy_set_header Host $host;

proxy_cache_bypass $http_upgrade;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

}

Browser DevTools Network-Tab Verifikation: F12 → Network → WS-Filter → Portainer laden

Name: ws

Status: 101 Switching Protocols

Type: websocket

Size: 0 B

Time: 45 ms

Unraid Community Applications Plugin Installation

In meinem Unraid-Setup hat sich diese Reihenfolge bewährt: Zuerst das Community Applications Plugin über die Plugin-Sektion installieren, dann nginx-proxy-manager über die Template-Suche finden. Der Pfad /mnt/user/appdata/nginx muss vor der Installation existieren, sonst schlägt das Template fehl.

# Unraid-spezifische Verzeichnisstruktur erstellen

mkdir -p /mnt/user/appdata/nginx/{data,letsencrypt}

chown -R nobody:users /mnt/user/appdata/nginx

Template-XML Pfad-Konfiguration:

<Config Name="Data" Target="/data" Default="/mnt/user/appdata/nginx/data" Mode="rw" Description="Config and Database" Type="Path" Display="always" Required="true" Mask="false">/mnt/user/appdata/nginx/data</Config>

Unraid Docker-Tab Troubleshooting: Bei „Container failed to start“ den Container-Log über das Unraid-WebUI prüfen. Häufiger Fehler: Falsche Pfad-Berechtigung oder Port-Konflikt mit anderen Containern.

Docker Compose external_links Migration – Vollständiges Beispiel

Hier die komplette Migration von external_links zu networks – in meinem Setup musste ich das für 8 Container durchführen:

Vorher (deprecated):

version: '3.8'

services:

nginx-proxy:

image: nginx:alpine

external_links:

- backend-app:backend

- database:db

ports:

- "80:80"

Nachher (korrekt):

version: '3.8'

services:

nginx-proxy:

image: nginx:alpine

container_name: nginx-proxy

networks:

- proxy-network

ports:

- "80:80"

networks:

proxy-network:

external: true

Migration-Schritte:

# 1. Bestehende Container stoppen

docker-compose down

# 2. External Network erstellen

docker network create proxy-network

# 3. Neue Konfiguration starten

docker-compose up -d

# 4. Network-Verbindung verifizieren

docker network inspect proxy-network

IPv6-Konfiguration für Docker Nginx Reverse Proxy

IPv6-Probleme treten besonders bei Cloud-Providern auf, die IPv6 standardmäßig aktiviert haben. Hier meine bewährte Konfiguration:

Docker IPv6 in daemon.json aktivieren:

{

"ipv6": true,

"fixed-cidr-v6": "2001:db8:1::/64",

"experimental": true,

"ip6tables": true

}

Nginx IPv6 Listen-Konfiguration:

server {

listen 80;

listen [::]:80;

listen 443 ssl;

listen [::]:443 ssl;

server_name example.com;

}

Docker Network mit IPv6 erstellen:

# IPv6-fähiges Network erstellen

docker network create --ipv6 --subnet=2001:db8:1::/64 proxy-network-v6

# ip6tables-Regeln für HTTP/HTTPS

ip6tables -A INPUT -p tcp --dport 80 -j ACCEPT

ip6tables -A INPUT -p tcp --dport 443 -j ACCEPT

Cloud-Provider Security Groups Konfiguration

AWS Security Groups:

# HTTP-Regel hinzufügen

aws ec2 authorize-security-group-ingress

--group-id sg-12345678

--protocol tcp

--port 80

--cidr 0.0.0.0/0

# HTTPS-Regel hinzufügen

aws ec2 authorize-security-group-ingress

--group-id sg-12345678

--protocol tcp

--port 443

--cidr 0.0.0.0/0

Azure NSG Inbound-Rules:

# HTTP-Regel erstellen

az network nsg rule create

--resource-group myResourceGroup

--nsg-name myNSG

--name Allow-HTTP

--protocol Tcp

--priority 100

--destination-port-range 80

--access Allow

GCP Firewall-Rules:

# HTTP/HTTPS-Ports freigeben

gcloud compute firewall-rules create allow-http-https

--allow tcp:80,tcp:443

--source-ranges 0.0.0.0/0

--description "Allow HTTP and HTTPS traffic"

bash

# Docker Desktop (Windows/Mac) - host.docker.internal verwenden

proxy_pass http://host.docker.internal:3000;

# Docker Linux - Docker Bridge Gateway verwenden

proxy_pass http://172.17.0.1:3000;

docker-compose.yml extra_hosts Konfiguration:

services:

nginx-proxy:

image: nginx:alpine

extra_hosts:

- "host.docker.internal:host-gateway"

# oder für Linux:

extra_hosts:

- "dockerhost:172.17.0.1"

Erwartete nginx.conf mit korrekter localhost-Alternative:

upstream backend {

server host.docker.internal:3000;

# Fallback für Linux

server 172.17.0.1:3000 backup;

}

Warum funktioniert localhost in Docker nicht?

In Docker-Containern bezieht sich localhost oder 127.0.0.1 auf das Container-interne Loopback-Interface, nicht auf den Host. Wenn dein Nginx-Container versucht, über localhost:3000 auf einen Backend-Container zuzugreifen, schlägt das fehl.

Korrekte Lösung:

# Falsch in nginx.conf

upstream backend {

server localhost:3000;

}

# Richtig - Container-Name verwenden

upstream backend {

server backend-app:3000;

}

Container-Namen als DNS testen:

# DNS-Auflösung im Nginx-Container prüfen

docker exec nginx-proxy nslookup backend-app

Wie debugge ich Container-zu-Container Kommunikation?

Container-zu-Container Kommunikation funktioniert nur innerhalb desselben Docker-Networks. Hier meine bewährte Debug-Strategie:

1. Network-Zugehörigkeit prüfen:

# Alle Container mit ihren Networks anzeigen

docker ps --format "table {{.Names}}t{{.Networks}}"

2. Ping-Test zwischen Containern:

# Von Nginx-Container zu Backend pingen

docker exec nginx-proxy ping -c 3 backend-app

3. Port-Erreichbarkeit testen:

# Telnet-Test auf Backend-Port

docker exec nginx-proxy telnet backend-app 3000

Wenn der Ping funktioniert, aber Telnet fehlschlägt, läuft der Backend-Service nicht oder lauscht auf der falschen IP.

Was tun bei Port bereits in Verwendung?

Der Fehler „Port already in use“ tritt auf, wenn der Host-Port bereits belegt ist. In meinen Tests passiert das oft nach unsauberen Container-Stops.

Port-Belegung identifizieren:

# Prozess auf Port 80 finden

lsof -i :80

Erwartete Ausgabe:

COMMAND PID USER FD TYPE DEVICE SIZE/OFF NODE NAME

nginx 1234 root 6u IPv4 12345 0t0 TCP *:http (LISTEN)

Container mit belegtem Port stoppen:

# Container anhand des Ports finden und stoppen

docker ps --filter "publish=80" --format "{{.Names}}" | xargs docker stop

Alternative Port-Mapping verwenden:

# Temporär anderen Host-Port verwenden

docker run -p 8080:80 nginx:alpine

Wie aktiviere ich Docker-Logging?

Docker-Logging ist standardmäßig aktiv, aber oft nicht ausreichend konfiguriert. Hier meine Logging-Konfiguration für Nginx-Debugging:

Container-Logs in Echtzeit verfolgen:

# Nginx-Logs live anzeigen

docker logs -f nginx-proxy

# Nur Fehler-Logs anzeigen

docker logs nginx-proxy 2>&1 | grep -i error

Detailliertes Nginx-Logging aktivieren: