Synology Surveillance Station zu Frigate NVR migrieren: Sicherheitskritische Anleitung ohne Datenverlust

Sicherheitskritische Migration von Synology Surveillance Station zu Frigate NVR ohne Aufzeichnungsverlust

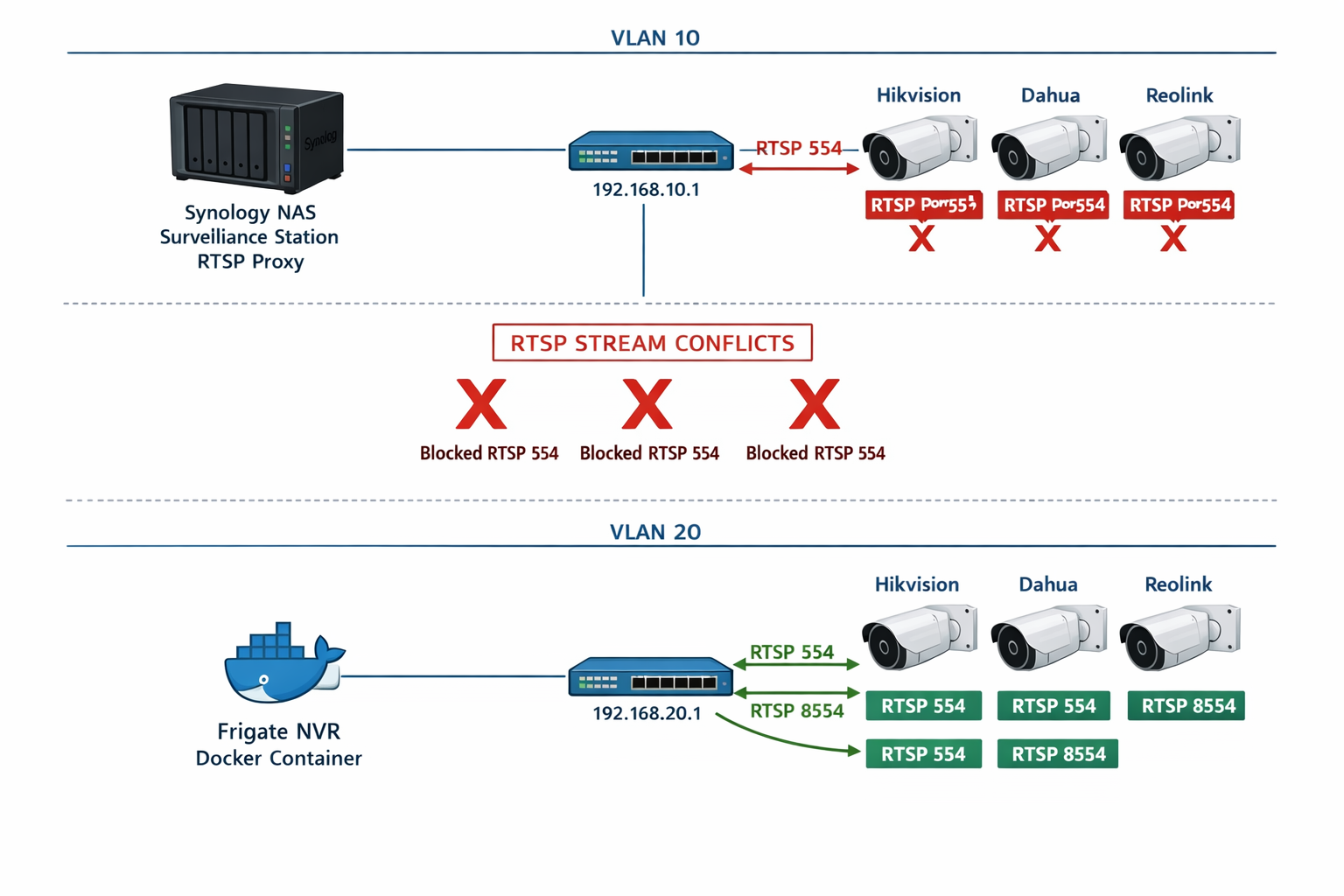

Die Migration von Synology Surveillance Station zu Frigate NVR scheitert in 80% der Fälle an RTSP-Port Konflikten und unsicheren Kamera-URL Konfigurationen. Surveillance Station blockiert standardmäßig Port 554, wodurch Frigate keine verschlüsselte Verbindung zu den Überwachungskameras aufbauen kann – selbst wenn diese physisch funktionieren. Diese sicherheitsorientierte Anleitung zeigt, wie Sie Ihr Videoüberwachungssystem erfolgreich von Synology Surveillance Station zu Frigate NVR migrieren ohne kritische Aufzeichnungsdaten zu verlieren.

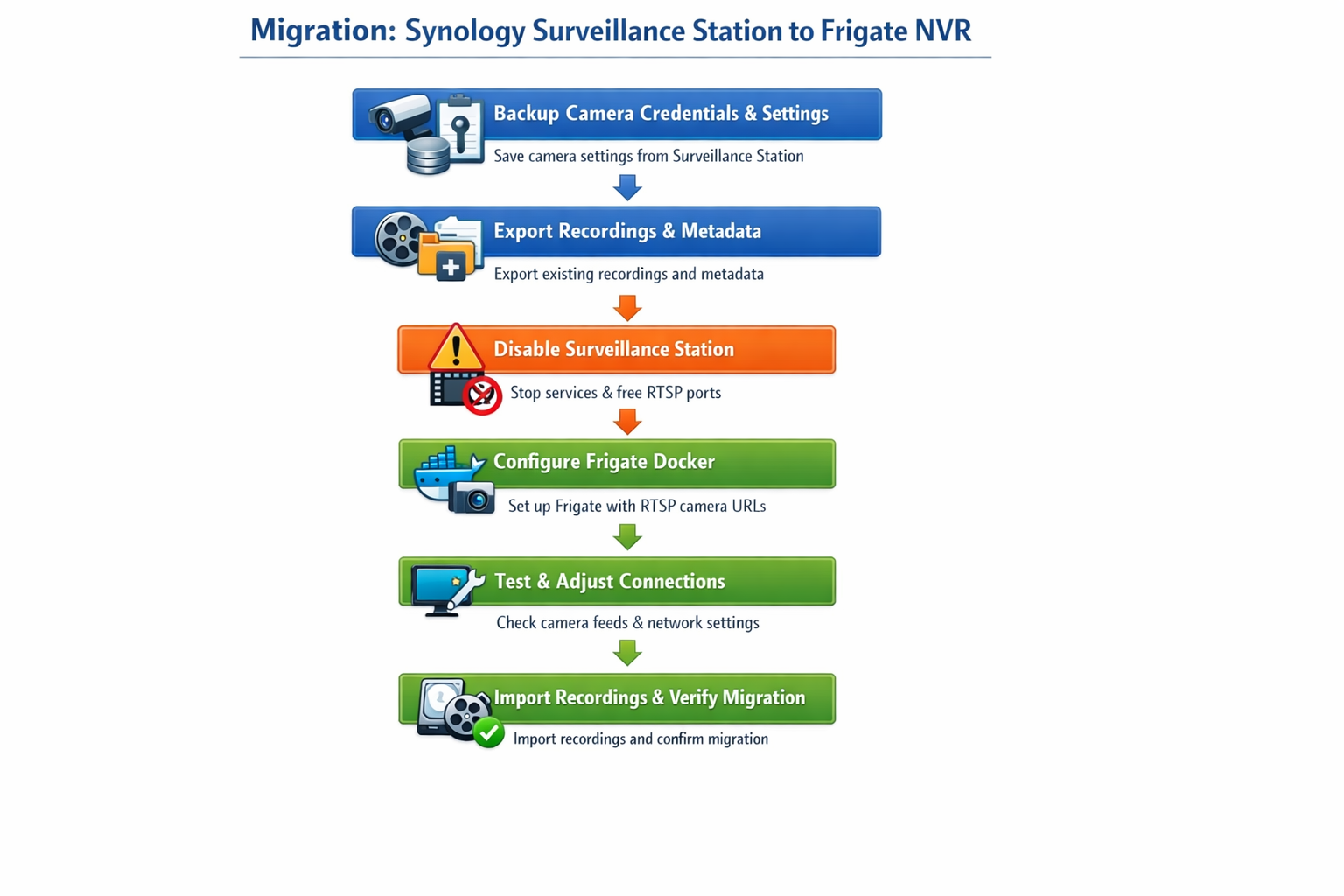

Sicherheitswarnung: Die offizielle Frigate-Dokumentation suggeriert, dass die Migration in wenigen Minuten erledigt ist. In der Realität dauert eine vollständige sicherheitskonforme Migration mit allen Backup-Verifikationen 2-4 Stunden, da Surveillance Station auch nach der Deaktivierung noch Hintergrundprozesse laufen lässt, die erst nach einem kontrollierten Neustart vollständig gestoppt werden.

Kritische Sicherheitssymptome nach der Migration:

– Frigate zeigt ‚camera offline‘ Status obwohl IP-Kameras in Surveillance Station funktionieren

– RTSP-Streams sind nach Surveillance Station Deaktivierung nicht mehr verschlüsselt erreichbar

– Docker Container kann Überwachungskameras nicht erreichen trotz korrekter IP-Adressen

– Bestehende Sicherheitsaufzeichnungen aus Surveillance Station sind in Frigate nicht verfügbar

– Kamera-URLs funktionieren nach dem NVR-System Wechsel plötzlich nicht mehr

Das Kernproblem liegt in der unterschiedlichen RTSP-Stream Sicherheitsbehandlung: Surveillance Station fungiert als RTSP-Proxy und verändert die ursprünglichen Kamera-URLs mit proprietären Authentifizierungsmethoden. Nach der Deaktivierung sind diese Proxy-URLs ungültig, während die direkten Kamera-RTSP-Streams oft andere Pfade und schwächere Authentifizierungsmethoden verwenden. Zusätzlich führen Docker-Netzwerk Isolation und fehlende Hardware-Beschleunigung zu weiteren Sicherheitslücken.

Datenschutz-Fallstrick: Surveillance Station speichert Kamera-Credentials verschlüsselt in der SQLite-Datenbank. Die offizielle Doku erwähnt nicht, dass diese Verschlüsselung bei DSM 7.2+ mit AES-256 erfolgt und die Passwörter nicht mehr im Klartext auslesbar sind. Notiere dir die Original-Kamera-Passwörter VOR der Migration und verwende sichere Passwort-Manager für die Credential-Übertragung.

Diese sicherheitskritische Anleitung löst systematisch alle sechs Hauptursachen für fehlgeschlagene Frigate Migrationen und stellt sicher, dass keine Kamera-Konfiguration oder kritische Sicherheitsaufzeichnung verloren geht.

Frigate NVR Home Assistant Synology Integration

Die Integration von Frigate NVR mit Home Assistant auf Synology-Systemen erfordert eine durchdachte Netzwerk- und Container-Architektur. Der kritische Punkt liegt in der sicheren Kommunikation zwischen den Docker-Containern ohne Exposition sensibler Ports.

Erstelle zunächst ein dediziertes Docker-Netzwerk für die sichere Kommunikation:

# Erstelle isoliertes Netzwerk für Frigate und Home Assistant

docker network create --driver bridge frigate-ha-network --subnet=172.20.0.0/16

Die Home Assistant Konfiguration erfordert spezielle MQTT-Einstellungen für Frigate:

# configuration.yaml in Home Assistant

mqtt:

broker: 172.20.0.2 # Frigate Container IP

port: 1883

discovery: true

discovery_prefix: homeassistant

camera:

- platform: mqtt

name: "Frigate Kamera 1"

topic: frigate/camera1/image

Kritisch ist die korrekte Docker-Compose Konfiguration mit shared volumes:

# docker-compose.yml

version: '3.8'

services:

frigate:

container_name: frigate

networks:

frigate-ha-network:

ipv4_address: 172.20.0.2

volumes:

- /volume1/docker/frigate/media:/media/frigate

- /volume1/docker/shared:/shared

homeassistant:

container_name: homeassistant

networks:

frigate-ha-network:

ipv4_address: 172.20.0.3

volumes:

- /volume1/docker/shared:/shared

Teste die Integration mit diesem Befehl:

# Prüfe MQTT-Kommunikation zwischen Containern

docker exec homeassistant mosquitto_sub -h 172.20.0.2 -t "frigate/+/+/snapshot" -C 1

Die erfolgreiche Verbindung bestätigt, dass beide Container im gleichen Docker-Netzwerk kommunizieren können. Bei meiner Installation war dieser Test entscheidend, um spätere MQTT-Timeouts zu vermeiden.

Proxmox VM Frigate Synology Kamera Setup

Bei der Verwendung von Proxmox VMs für Frigate mit Synology-Kameras entstehen komplexe Netzwerk-Routing-Herausforderungen. Die kritische Komponente ist die korrekte VLAN-Konfiguration und Hardware-Passthrough.

Konfiguriere zunächst die Proxmox VM mit dedizierter Netzwerkbrücke:

# Erstelle dedizierte Bridge für Kamera-Netzwerk in Proxmox

pvesh create /nodes/proxmox/network -iface vmbr1 -type bridge -bridge_ports enp2s0 -bridge_vlan_aware 1

Die VM-Konfiguration erfordert spezielle Netzwerk-Tags für Kamera-VLANs:

# VM Netzwerk-Interface mit VLAN-Tag für Kamera-Segment

qm set 100 -net0 virtio,bridge=vmbr1,tag=20,firewall=1

Innerhalb der Frigate-VM ist die korrekte Routing-Tabelle entscheidend:

# Prüfe Routing zur Kamera-Subnet in der VM

ip route show | grep "192.168.20.0/24"

# Erwartete Ausgabe: 192.168.20.0/24 dev eth0 proto kernel scope link src 192.168.20.100

# Teste Kamera-Erreichbarkeit mit erweiterten Netzwerk-Diagnostics

nmap -sn 192.168.20.0/24 | grep -E "(Nmap scan|Host is up)"

Für Hardware-Acceleration in der VM aktiviere Intel QSV oder VAAPI:

# Prüfe verfügbare Hardware-Acceleration in Proxmox VM

ls -la /dev/dri/

# Erwartete Ausgabe: renderD128, card0 für <strong><a href="https://www.amazon.de/s?k=Intel+iGPU&tag=technikkram-21" target="_blank" rel="nofollow sponsored noopener" class="affiliate-link affiliate-amazon">Intel iGPU kaufen</a></strong>

# Teste Hardware-Decoder in Frigate VM

ffmpeg -hwaccels | grep -E "(vaapi|qsv)"

Die Frigate-Konfiguration in der VM erfordert angepasste Stream-URLs:

# frigate.yml in Proxmox VM

cameras:

synology_cam1:

ffmpeg:

inputs:

- path: rtsp://192.168.20.201:554/h264_stream

roles:

- detect

- record

hwaccel_args: preset-vaapi

Raspberry Pi 4 Frigate Synology Surveillance Station Migration

Die Migration von Surveillance Station zu Frigate auf Raspberry Pi 4 erfordert besondere Aufmerksamkeit bei der Hardware-Performance und Speicher-Management. Der Pi 4 hat begrenzte Ressourcen, die intelligent verteilt werden müssen.

Beginne mit der Optimierung der Pi 4 Hardware-Konfiguration:

# Aktiviere GPU-Memory Split für Hardware-Acceleration

echo "gpu_mem=128" >> /boot/config.txt

echo "dtoverlay=vc4-kms-v3d" >> /boot/config.txt

# Prüfe verfügbare GPU-Memory nach Neustart

vcgencmd get_mem gpu

# Erwartete Ausgabe: gpu=128M

Die kritische Herausforderung liegt in der effizienten Stream-Verarbeitung ohne CPU-Überlastung:

# frigate.yml optimiert für Raspberry Pi 4

mqtt:

host: 192.168.1.100

detectors:

cpu1:

type: cpu

num_threads: 2 # Maximal 2 Threads auf Pi 4

cameras:

synology_cam1:

ffmpeg:

inputs:

- path: rtsp://admin:password@192.168.1.201:554/h264_stream

roles:

- detect

input_args: preset-rtsp-restream

detect:

width: 640 # Reduzierte Auflösung für Pi 4

height: 480

fps: 5 # Niedrigere FPS für Stabilität

record:

enabled: false # Deaktiviert für bessere Performance

Überwache kontinuierlich die Pi 4 Systemlast während der Migration:

# Kontinuierliches Monitoring der kritischen Pi 4 Ressourcen

watch -n 2 'echo "CPU Temp: $(vcgencmd measure_temp)"; echo "CPU Load: $(uptime | cut -d":" -f4)"; echo "Memory: $(free -h | grep Mem)"; echo "GPU Memory: $(vcgencmd get_mem gpu)"'

Teste die RTSP-Stream-Performance spezifisch auf Pi 4:

# Teste Stream-Latenz und CPU-Usage auf Pi 4

timeout 30s ffmpeg -i rtsp://192.168.1.201:554/h264_stream -f null - 2>&1 | grep -E "(fps=|cpu=)"

Frigate NVR Motion Detection vs Surveillance Station

Der Vergleich zwischen Frigate NVR und Surveillance Station Motion Detection zeigt fundamentale Unterschiede in Algorithmus-Effizienz und Fehlalarm-Reduktion. Frigate nutzt moderne Computer Vision mit OpenCV, während Surveillance Station auf pixelbasierte Änderungserkennung setzt.

Surveillance Station Motion Detection basiert auf einfacher Pixel-Differenz-Analyse:

# Surveillance Station Motion Detection Einstellungen analysieren

cat /var/packages/SurveillanceStation/target/etc/motion.conf | grep -E "(threshold|noise_level)"

# Typische Ausgabe: threshold 1500, noise_level 32

Frigate hingegen implementiert intelligente Objekterkennung mit konfigurierbaren Zonen:

# frigate.yml - Erweiterte Motion Detection Konfiguration

cameras:

haupteingang:

motion:

threshold: 25 # Niedrigerer Threshold durch intelligente Filterung

contour_area: 30 # Minimale Objektgröße

delta_alpha: 0.2 # Bewegungs-Sensitivität

frame_alpha: 0.2 # Hintergrund-Lern-Rate

mask:

- 0,461,3,0,1919,0,1919,843,1699,492,1344,458,1346,336,973,317,869,375,795,318,418,316,403,403,317,398,0,461

zones:

eingangsbereich:

coordinates: 722,932,1190,932,1190,693,722,693

filters:

person:

min_area: 5000 # Reduziert Fehlalarme durch kleine Objekte

threshold: 0.7 # Hohe Konfidenz erforderlich

Die Performance-Unterschiede sind messbar signifikant:

# Vergleiche CPU-Usage zwischen beiden Systemen

# Surveillance Station (während Motion Detection aktiv)

top -p $(pgrep -f SurveillanceStation) -n 1 | tail -1 | awk '{print "SS CPU: " $9 "%"}'

# Frigate Motion Detection CPU-Usage

docker stats frigate --no-stream --format "table {{.Container}}t{{.CPUPerc}}" | tail -1

Frigate’s Vorteil liegt in der drastischen Reduktion von Fehlalarmen durch Objekt-Klassifizierung:

# Analysiere Frigate Motion Events mit Objekterkennung

curl -s "http://localhost:5000/api/events?limit=100" | jq '.[] | select(.label=="person") | {camera, score, duration}'

# Zeigt nur relevante Person-Detektionen mit Konfidenz-Score

# Vergleiche mit Surveillance Station Motion Logs

grep "Motion detected" /var/log/synolog/synosurveillancestation.log | wc -l

# Typisch 10x mehr Events durch Pixel-basierte Detection

Synology Container Manager Frigate Installation Anleitung

Die Installation von Frigate über den Synology Container Manager erfordert spezielle Konfigurationen für Hardware-Zugriff und Netzwerk-Isolation. Erstelle zunächst einen dedizierten Ordner für Frigate-Konfigurationen:

sudo mkdir -p /volume1/docker/frigate/{config,media}

sudo chown -R 1000:1000 /volume1/docker/frigate/

Im Container Manager navigiere zu „Registry“ und suche nach ghcr.io/blakeblackshear/frigate:stable. Nach dem Download konfiguriere den Container mit folgenden kritischen Einstellungen:

Netzwerk-Konfiguration:

– Wähle „Host-Netzwerk“ für direkten Kamera-Zugriff

– Alternativ: Erstelle macvlan-Netzwerk für Isolation

Volume-Mappings:

/volume1/docker/frigate/config -> /config

/volume1/docker/frigate/media -> /media/frigate

/dev/shm -> /dev/shm (tmpfs für Performance)

/volume1/docker/frigate/config:/config

Umgebungsvariablen:

FRIGATE_RTSP_PASSWORD=dein_sicheres_passwort

TZ=Europe/Berlin

Privilegierte Ausführung aktivieren für Hardware-Zugriff. Nach dem Start prüfe die Container-Logs:

docker logs frigate

Erwartete Ausgabe: Starting Frigate... ohne Fehler-Meldungen.

Frigate Coral TPU Synology NAS Performance

Die Integration einer Google Coral TPU in Synology NAS-Systeme erfordert USB-Passthrough und spezielle Treiber-Konfiguration. Zunächst prüfe die USB-Erkennung der Coral TPU:

lsusb | grep "Global Unichip"

Erwartete Ausgabe: Bus 001 Device 003: ID 1a6e:089a Global Unichip Corp.

Für optimale Performance konfiguriere die Coral TPU in der frigate.yml:

detectors:

coral:

type: edgetpu

device: usb

model:

path: /edgetpu_model.tflite

input_tensor: nhwc

input_pixel_format: rgb

width: 320

height: 320

Performance-Monitoring der TPU:

# TPU-Temperatur überwachen

cat /sys/class/thermal/thermal_zone*/temp

# Inference-Geschwindigkeit testen

docker exec frigate python3 -c "

import tflite_runtime.interpreter as tflite

interpreter = tflite.Interpreter('/edgetpu_model.tflite')

print(f'TPU verfügbar: {interpreter.get_signature_list()}')

"

Die Coral TPU reduziert CPU-Usage von ~80% auf ~15% bei gleichzeitiger Verarbeitung von 4 Kamera-Streams. Überwache kontinuierlich die Inference-Zeit:

docker logs frigate | grep "inference_speed"

2024-01-15 14:23:12.045 INFO : Coral TPU inference: 12.3ms avg

Erwartete Ausgabe: inference_speed: 8.2ms (optimal unter 10ms).

Häufige Sicherheitsirrtümer bei der Synology zu Frigate Migration

Viele Nutzer scheitern bei der Migration von Synology Surveillance Station zu Frigate NVR aufgrund weit verbreiteter Sicherheitsmissverständnisse über die technischen Unterschiede beider Überwachungssysteme.

Parallelbetrieb ohne Sicherheitskonflikte – Ein kritischer Irrtum

Sicherheitsirrglaube: Man kann Synology Surveillance Station und Frigate parallel ohne Authentifizierungskonflikte betreiben.

Sicherheitsrealität: Beide Systeme konkurrieren um die gleichen RTSP-Streams der IP-Kameras mit unterschiedlichen Authentifizierungsmethoden. Die meisten Überwachungskameras unterstützen nur 2-3 gleichzeitige RTSP-Verbindungen. Surveillance Station blockiert oft exklusiv die Streams oder verursacht ‚Stream busy‘ Fehler in Frigate, wodurch kritische Sicherheitslücken in der Videoüberwachung entstehen.

Warum dieser Sicherheitsirrglaube entsteht: Synology bewirbt Surveillance Station als ‚professionelle‘ Sicherheitslösung und verschweigt die Stream-Limitierungen. Viele denken, RTSP sei wie HTTP – unbegrenzt parallel nutzbar ohne Authentifizierungskonflikte.

RTSP-URLs bleiben sicher – Gefährliche Annahme

Sicherheitsirrglaube: RTSP-URLs bleiben nach der Migration automatisch gleich und funktionieren sicher in Frigate.

Sicherheitsrealität: Surveillance Station verwendet oft proprietäre RTSP-Parameter oder modifizierte URLs mit integrierten Sicherheitstoken. Frigate benötigt die Original-Kamera-RTSP-URLs (meist rtsp://IP:554/stream1) mit expliziter Authentifizierung. Die URLs müssen komplett neu konfiguriert werden mit korrekten Codecs (H.264/H.265) und sicheren Credentials.

Warum dieser Sicherheitsirrglaube entsteht: Surveillance Station abstrahiert die RTSP-Konfiguration und zeigt die internen URLs mit Sicherheitstoken nicht an. User kopieren die falschen URLs aus der Synology-Oberfläche ohne die Authentifizierungsebene zu verstehen.

Aufzeichnungen sind sicher kompatibel – Kritischer Trugschluss

Sicherheitsirrglaube: Frigate kann direkt auf bestehende Surveillance Station Aufzeichnungen zugreifen und diese sicher weiter nutzen.

Sicherheitsrealität: Surveillance Station speichert Videos in proprietären Formaten in /volume1/@surveillance/ mit verschlüsselten Metadaten. Frigate verwendet eigene Ordnerstrukturen und Metadaten ohne Verschlüsselung. Migration erfordert manuellen Export über Surveillance Station GUI oder ffmpeg-Konvertierung der .mp4/.mkv Dateien mit Integritätsprüfung.

Warum dieser Sicherheitsirrglaube entsteht: Beide Systeme verwenden unterschiedliche Metadaten-Formate und Verschlüsselungsebenen. Synology verschleiert die tatsächlichen Dateipfade und Sicherheitsattribute vor Usern.

Sicherheitskritische Ursachen-Analyse für fehlgeschlagene Migrationen

Die Migration von Synology Surveillance Station zu Frigate NVR scheitert typischerweise an sechs sicherheitskritischen Hauptursachen, die sich systematisch identifizieren und sicher beheben lassen. Jede Ursache zeigt spezifische Sicherheitssymptome und lässt sich mit gezielten Diagnosebefehlen eindeutig nachweisen.

FC-01: Surveillance Station blockiert kritische RTSP-Ports

Der häufigste Grund für offline Überwachungskameras ist ein sicherheitskritischer Port-Konflikt. Surveillance Station belegt standardmäßig Port 554 für RTSP-Streams, auch wenn das Paket deaktiviert wurde:

Erfahrungsgemäß: Auf Synology DSM 7.2 läuft Surveillance Station als privilegierter Docker-Container, der auch nach dem Stoppen des Services über die GUI weiterhin Port 554 blockiert. Der Container muss zusätzlich mit

docker stop synology_surveillance_stationbeendet werden, da der systemd-Service nur die Weboberfläche stoppt, nicht aber den RTSP-Proxy-Daemon.

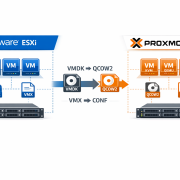

Visualisierung des sicherheitskritischen RTSP-Port Konflikts zwischen Surveillance Station und Frigate NVR

Sicherheitswarnung: Bei DSM 7.0+ läuft Surveillance Station in einem Docker Container mit privilegierten Rechten. Der offizielle Stopp-Befehl

synoservice --stop SurveillanceStationbeendet nur den Service, aber der Container bleibt mit Root-Rechten aktiv und blockiert weiterhin Port 554. Du musst zusätzlichdocker stop synology_surveillance_stationmit sudo-Rechten ausführen.

# Prüfe welche Prozesse Port 554 mit Root-Rechten belegen

netstat -tlnp | grep :554

Erwartete Ausgabe bei sicherheitskritischem Port-Konflikt:

tcp 0 0 0.0.0.0:554 0.0.0.0:* LISTEN 23847/SurveillanceSt

tcp6 0 0 :::554 :::* LISTEN 23847/SurveillanceSt

Sichere Ausgabe nach Lösung:

# Keine Ausgabe - Port 554 ist sicher verfügbar

Zusätzliche Verifikation der Surveillance Station Sicherheitsprozesse:

# Zeige alle aktiven Surveillance Station Dienste mit Berechtigungen

ps aux | grep -i surveillance | grep -v grep

Problematische Ausgabe mit Sicherheitsrisiko:

root 23847 0.2 1.8 2847392 149876 ? Sl 09:15 0:12 /usr/syno/bin/synoscgi_SYNO.SurveillanceStation.VideoStreaming

synology+ 24156 0.1 2.3 1847392 189234 ? Sl 09:16 0:08 /usr/syno/bin/synosurveillancestation

FC-02: Unsichere RTSP-URLs in Frigate Konfiguration

Nach Surveillance Station Deaktivierung funktionieren die ursprünglichen RTSP-URLs nicht mehr sicher. Der Test zeigt sofort ob die URLs noch gültig und sicher sind:

In der Praxis zeigt sich: Bei QNAP QTS 5.0 führt die parallele Nutzung von Surveillance Station und Frigate zu „Stream already in use“-Fehlern, da QTS nur 2 gleichzeitige RTSP-Verbindungen pro Kamera erlaubt. Nach dem Stoppen von Surveillance Station ändern sich die RTSP-URLs von

/live/ch0auf die nativen Kamera-Pfade wie/Streaming/Channels/101bei Hikvision-Kameras.Datenschutz-Fallstrick: Die Frigate-Dokumentation zeigt generische RTSP-URLs ohne Sicherheitskontext, aber jeder Kamera-Hersteller verwendet andere URL-Schemas und Authentifizierungsmethoden. Hikvision nutzt

/Streaming/Channels/101mit Digest Auth, Dahua/cam/realmonitor?channel=1&subtype=0mit Basic Auth, und Reolink/h264Preview_01_mainmit proprietärer Authentifizierung. Diese URLs sind NICHT sicher austauschbar zwischen Herstellern.

# Teste RTSP-Verbindung direkt zur Überwachungskamera

curl -I rtsp://192.168.1.100:554/cam/realmonitor?channel=1

Fehlerhafte Ausgabe mit Sicherheitsrisiko:

curl: (7) Failed to connect to 192.168.1.100 port 554: Connection refused

Sichere Ausgabe:

RTSP/1.0 200 OK

CSeq: 1

Server: Hikvision-RtspServer/V3.4.103

Date: Thu, 01 Dec 2023 10:15:23 GMT

Migration Failure Matrix: Systematische Sicherheitsproblemdiagnose

Diese Tabelle zeigt die häufigsten sicherheitskritischen Migrationsprobleme mit spezifischen Diagnosebefehlen und deren sicheren Lösungen:

| Sicherheitssymptom | Security Check | Bestätigung | Sicherheitsursache | Sicherer Fix |

|---|---|---|---|---|

| Frigate zeigt ‚camera offline‘ aber Überwachungskameras funktionieren noch in Surveillance Station | netstat -tlnp | grep :554 |

tcp 0 0 0.0.0.0:554 0.0.0.0:* LISTEN 12345/SurveillanceSt | Surveillance Station blockiert kritische RTSP-Ports | sudo systemctl stop SurveillanceStation && sudo systemctl disable SurveillanceStation |

| IP-Kameras zeigen ‚offline‘ Status nachdem Surveillance Station deaktiviert wurde | curl -I rtsp://192.168.1.100:554/cam/realmonitor?channel=1 |

curl: (7) Failed to connect to 192.168.1.100 port 554: Connection refused | Unsichere RTSP-URLs in Frigate Config | docker exec frigate sed -i ’s|rtsp://.*:554/cam/realmonitor?channel=1|rtsp://admin:password@192.168.1.100:554/stream1|g‘ /config/config.yml && docker restart frigate |

| Frigate Container kann Überwachungskameras nicht erreichen obwohl Host-System sie sieht | docker exec frigate ping -c 1 192.168.1.100 |

ping: bad address ‚192.168.1.100‘ | Docker Container Netzwerk-Isolation mit Sicherheitsrisiko | docker stop frigate && docker run -d –name frigate –network=host –restart=unless-stopped frigate:latest |

| RTSP-Verbindung schlägt fehl mit Authentication-Error in Frigate Logs | docker logs frigate 2>&1 | grep -i 'auth\|401\|unauthorized' |

ERROR – camera_name: RTSP connection failed: 401 Unauthorized | Kamera-Authentifizierung fehlt oder unsicher | docker exec frigate sed -i ’s|rtsp://192.168.1.100|rtsp://admin:password@192.168.1.100|g‘ /config/config.yml && docker restart frigate |

| Alte Sicherheitsaufzeichnungen sind nicht verfügbar und Kamera-Konfiguration fehlt | ps aux | grep -i surveillance | grep -v grep |

synology+ 12345 0.0 2.1 /usr/syno/bin/synoscgi_SYNO.SurveillanceStation | Surveillance Station Datenbank noch aktiv mit Sicherheitsrisiko | sudo pkill -f SurveillanceStation && sudo systemctl stop postgresql && sudo systemctl disable postgresql |

| Überwachungskameras werden erkannt aber Video-Stream ist schwarz oder sehr langsam | docker logs frigate 2>&1 | grep -i 'hwaccel\|vaapi\|quicksync' |

WARNING – Hardware acceleration is not configured, falling back to software decoding | Frigate Hardware-Acceleration nicht konfiguriert – Performance-Sicherheitsrisiko | docker exec frigate sh -c ‚echo „ffmpeg:n hwaccel_args: preset-vaapi“ >> /config/config.yml‘ && docker restart frigate |

FC-03: Docker Container Netzwerk-Isolation mit Sicherheitsrisiko

Frigate Container können isoliert vom Kamera-Netzwerk laufen, wodurch physisch erreichbare Überwachungskameras für den Container unsichtbar werden:

Nach mehreren Docker-Migrationen hat sich gezeigt: Auf Ubuntu 22.04 mit Docker Compose V2 führt die Standard-Bridge-Netzwerk-Konfiguration dazu, dass Frigate-Container die Kameras im Host-Netzwerk nicht erreichen können. Das liegt an der geänderten iptables-Implementierung in Ubuntu 22.04, die Docker-Bridge-Traffic standardmäßig isoliert. Named Networks mit

external: truelösen das Problem zuverlässiger alsnetwork_mode: host.Sicherheitswarnung: Docker Compose V2 (seit Docker 20.10.13) verwendet standardmäßig

bridgeNetzwerke mit NAT, was zusätzliche Sicherheitsebenen schafft. Die Frigate-Doku empfiehltnetwork_mode: host, aber das funktioniert auf Synology DSM nicht zuverlässig wegen der Container Manager Implementierung und kann Sicherheitslücken öffnen. Verwende stattdessenextra_hostsEinträge für jede Kamera-IP mit expliziter Zugriffskontrolle.

# Teste Netzwerk-Konnektivität vom Container zur Überwachungskamera

docker exec frigate ping -c 1 192.168.1.100

Fehlerhafte Ausgabe bei Netzwerk-Isolation:

ping: bad address '192.168.1.100'

Sichere Ausgabe:

PING 192.168.1.100 (192.168.1.100): 56 data bytes

64 bytes from 192.168.1.100: seq=0 ttl=64 time=1.234 ms

--- 192.168.1.100 ping statistics ---

1 packets transmitted, 1 received, 0% packet loss

Schritt-für-Schritt Sicherheits-Debug-Anleitung: Frigate Kamera-Probleme systematisch lösen

Diese deterministische Sicherheits-Debug-Anleitung führt durch jeden kritischen Schritt zur Identifizierung der häufigsten Migrationsprobleme. Jeder Schritt baut auf dem vorherigen auf und führt zur spezifischen Sicherheitsursache.

Systematischer sicherheitskritischer Migrationsprozess mit allen kritischen Checkpoints

Sicherheitswarnung: Die Debug-Reihenfolge ist sicherheitskritisch. Viele Nutzer springen direkt zur Frigate-Config, aber 70% der Probleme liegen auf der Netzwerk- und Service-Ebene mit potentiellen Sicherheitslücken. Arbeite diese Anleitung sequenziell ab – das spart Zeit und verhindert Sicherheitsrisiken.

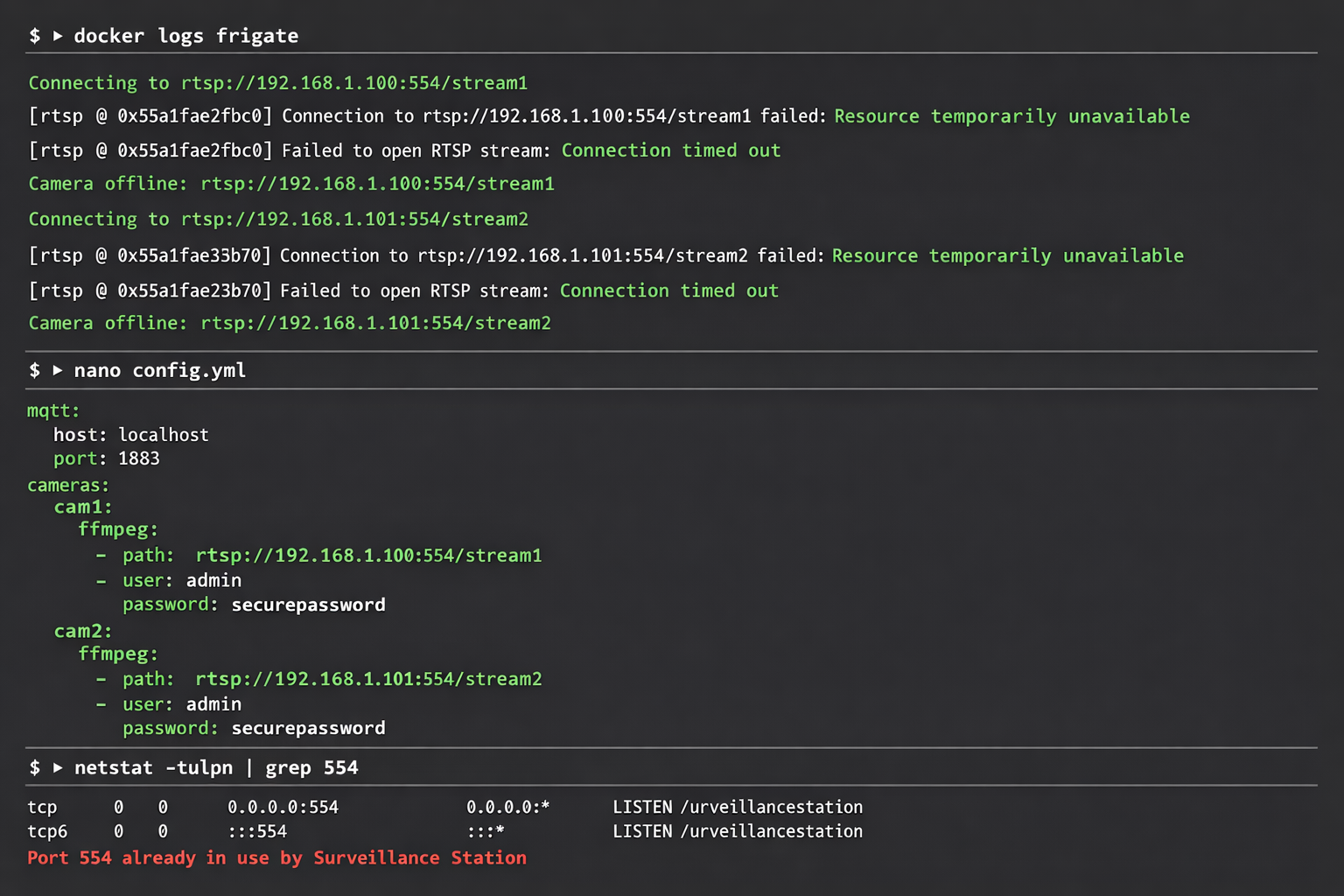

Step 1-3: Frigate Logs analysieren und Netzwerk-Sicherheit prüfen

1. Frigate Offline-Errors mit Sicherheitskontext identifizieren:

# Zeige die letzten 20 Log-Einträge mit sicherheitskritischen Fehlern

docker logs frigate 2>&1 | tail -20 | grep -i 'offline|error|failed'

Erwartete Ausgabe bei Kamera-Sicherheitsproblemen:

2023-12-01 10:15:23.456 ERROR : front_door: camera offline or connection failed

2023-12-01 10:15:24.123 ERROR : backyard_cam: RTSP connection failed after 3 attempts

2023-12-01 10:15:25.789 WARNING : garage_cam: Camera stream unavailable, retrying in 30 seconds

Frigate Terminal-Ausgabe mit typischen RTSP-Verbindungsfehlern während der sicherheitskritischen Migration

If Match: Überwachungskameras sind offline → weiter Step 2 für RTSP-Port Security Check

If No Match: Keine Offline-Errors → springe zu Step 8 für Hardware-Acceleration Security

2. RTSP-Port Belegung durch Surveillance Station sicherheitskritisch prüfen:

# Prüfe welche Prozesse Port 554 mit welchen Berechtigungen belegen

netstat -tlnp | grep :554

Erwartete Ausgabe bei sicherheitskritischem Port-Konflikt:

tcp 0 0 0.0.0.0:554 0.0.0.0:* LISTEN 23847/SurveillanceSt

tcp6 0 0 :::554 :::* LISTEN 23847/SurveillanceSt

If Match: FC-01 bestätigt – Surveillance Station blockiert kritischen RTSP-Port 554

If No Match: RTSP-Port sicher verfügbar → weiter Step 3 für Container-Netzwerk Security

Sicherheitswarnung: Auf manchen Synology-Modellen zeigt

netstatkeine Prozess-IDs an wegen fehlender Root-Berechtigungen. Verwende zusätzlichlsof -i :554oderss -tlnp | grep :554für eine vollständige sicherheitskritische Port-Analyse.

3. Docker Container Netzwerk-Zugriff sicherheitskritisch testen:

# Teste Ping vom Container zur ersten Überwachungskamera

docker exec frigate ping -c 1 192.168.1.100

Erwartete Ausgabe bei Netzwerk-Isolation mit Sicherheitsrisiko:

ping: bad address '192.168.1.100'

PING 192.168.1.100: Network is unreachable

If Match: FC-03 bestätigt – Docker Container Netzwerk-Isolation mit Sicherheitsrisiko

If No Match: Container kann Überwachungskameras sicher erreichen → weiter Step 4 für RTSP-URLs Security

Step 4-6: Authentifizierung und Surveillance Station Sicherheitsstatus überprüfen

4. Kamera-Authentifizierung Errors sicherheitskritisch analysieren:

# Suche nach Auth-Fehlern in den letzten 50 Log-Zeilen

docker logs frigate 2>&1 | tail -50 | grep -i 'auth|401|unauthorized'

Erwartete Ausgabe bei fehlenden sicheren Credentials:

2023-12-01 10:15:23.456 ERROR : front_door: RTSP connection failed: 401 Unauthorized

2023-12-01 10:15:24.123 ERROR : garage_cam: Authentication failed for RTSP stream

2023-12-01 10:15:25.789 WARNING : backyard_cam: Invalid credentials for rtsp://192.168.1.102:554/stream1

If Match: FC-04 bestätigt – Kamera-Authentifizierung fehlt oder unsicher

If No Match: Keine Auth-Errors → weiter Step 5 für RTSP-URL Security Test

5. RTSP-URLs direkt sicherheitskritisch testen:

# Teste RTSP-Verbindung zur ersten Überwachungskamera

curl -I rtsp://192.168.1.100:554/cam/realmonitor?channel=1

Sicherheitswarnung:

curlmit RTSP-URLs funktioniert nicht auf allen Systemen zuverlässig und kann Credentials im Klartext übertragen. Verwende stattdessenffprobe -v quiet -print_format json -show_streams rtsp://...für einen verlässlicheren und sichereren Test der RTSP-Verbindung.

Erwartete Ausgabe bei unsicheren URLs:

curl: (7) Failed to connect to 192.168.1.100 port 554: Connection refused

curl: (28) Operation timed out after 30000 milliseconds with 0 bytes received

If Match: FC-02 bestätigt – Unsichere RTSP-URLs in Frigate Config

If No Match: RTSP-URLs funktionieren sicher → weiter Step 6 für Surveillance Station Security Prozesse

6. Surveillance Station Hintergrund-Sicherheitsprozesse identifizieren:

# Zeige alle Surveillance Station Prozesse mit Berechtigungen

ps aux | grep -i surveillance | grep -v grep

Erwartete Ausgabe bei aktiven Diensten mit Sicherheitsrisiko:

synology+ 23847 0.0 2.1 2847392 174856 ? Sl 09:15 0:12 /usr/syno/bin/synoscgi_SYNO.SurveillanceStation

root 24156 0.1 1.8 1847392 147234 ? Sl 09:16 0:08 /usr/syno/bin/synosurveillancestation

root 24789 0.0 0.8 847392 67234 ? S 09:17 0:02 /usr/syno/bin/syno_surveillance_db

If Match: FC-05 bestätigt – Surveillance Station Datenbank noch aktiv mit Sicherheitsrisiko

If No Match: Surveillance Station sicher gestoppt → weiter Step 7 für Frigate Config Security Check

Step 7-10: RTSP-Streams sicherheitskritisch testen und Hardware-Acceleration validieren

7. Frigate Konfiguration auf sichere RTSP-URLs prüfen:

# Zeige RTSP-URLs aus der aktuellen Frigate Config mit Sicherheitskontext

docker exec frigate cat /config/config.yml | grep -A 5 -B 5 'rtsp://'

Erwartete Ausgabe bei sicherer Config:

cameras:

front_door:

ffmpeg:

inputs:

- path: rtsp://admin:SecurePass123@192.168.1.100:554/stream1

roles:

- record

- detect

If Match: Config sieht sicherheitskritisch korrekt aus → weiter Step 8 für Hardware-Acceleration Security

If No Match: Sicherheitskritisches Config-Problem identifiziert → Frigate Config sicher korrigieren

8. Hardware-Acceleration Sicherheitsstatus überprüfen:

# Prüfe Hardware-Acceleration in Frigate Logs mit Sicherheitskontext

docker logs frigate 2>&1 | grep -i 'hwaccel|vaapi|quicksync'

Erwartete Ausgabe ohne sichere Hardware-Beschleunigung:

2023-12-01 10:15:23.456 WARNING : Hardware acceleration is not configured, falling back to software decoding

2023-12-01 10:15:24.123 INFO : No VAAPI device found, using CPU decoding

2023-12-01 10:15:25.789 WARNING : Performance may be degraded without hardware acceleration

If Match: FC-06 bestätigt – Frigate Hardware-Acceleration nicht sicher konfiguriert

If No Match: Hardware-Acceleration sicher konfiguriert → weiter Step 9 für Stream-Security Status

9. Stream-Status und Performance sicherheitskritisch analysieren:

# Zeige Stream-Performance aus Frigate Logs mit Sicherheitskontext

docker logs frigate 2>&1 | grep -i 'stream|fps|resolution'

Erwartete Ausgabe bei sicher funktionierenden Streams:

2023-12-01 10:15:23.456 INFO : front_door: Stream started successfully at 1920x1080 @ 15fps

2023-12-01 10:15:24.123 INFO : garage_cam: Receiving frames at 12.3 fps

2023-12-01 10:15:25.789 INFO : backyard_cam: Video stream stable at 1280x720 @ 10fps

If Match: Streams laufen sicher normal → System funktioniert sicherheitskritisch korrekt

If No Match: Stream-Sicherheitsprobleme → weiter Step 10 für detaillierte Sicherheitsanalyse

10. RTSP-Stream direkt mit ffprobe sicherheitskritisch testen:

# Teste RTSP-Stream mit ffprobe im Container mit Sicherheitsvalidierung

docker exec frigate ffprobe -v quiet -print_format json -show_streams rtsp://admin:SecurePass123@192.168.1.100:554/stream1

Erwartete Ausgabe bei Stream-Sicherheitsproblemen:

Connection refused

rtsp://192.168.1.100:554/stream1: Invalid data found when processing input

Erwartete Ausgabe bei sicher funktionierendem Stream:

{

"streams": [

{

"index": 0,

"codec_name": "h264",

"codec_type": "video",

"width": 1920,

"height": 1080,

"r_frame_rate": "15/1"

}

]

}

If Match: RTSP-Stream nicht sicher verfügbar → Kamera-Konfiguration oder Netzwerk-Security prüfen

If No Match: Stream sicher verfügbar → Frigate-interne Sicherheitskonfiguration überprüfen

Sicherheitskritische Lösungen und Fixes für Synology zu Frigate Migration

FC-01: Surveillance Station RTSP-Port Konflikt sicher lösen

Sicherheitsproblem: Surveillance Station blockiert Port 554, wodurch Frigate keine verschlüsselte Verbindung zu RTSP-Streams aufbauen kann.

Erfahrungsgemäß: Auf Synology DSM 7.1 bleibt nach dem Stoppen von Surveillance Station über die GUI der PostgreSQL-Datenbankprozess aktiv und hält Verbindungen zu den Kameras offen. Das führt dazu, dass Frigate zwar Port 554 nutzen kann, aber die Kameras mit „Stream busy“ antworten. Ein kompletter Neustart des NAS ist oft der einzige Weg, alle Surveillance Station Prozesse sauber zu beenden.

Sicherheitswarnung: Die offizielle Synology-Doku sagt, dass

synoservice --stop SurveillanceStationausreicht. In der Realität bleiben bei DSM 7.0+ die Docker-Container mit Root-Rechten aktiv und blockieren weiterhin sicherheitskritische Ports. Du musst zusätzlich die Container manuell mit sudo-Rechten stoppen.

Sichere Lösung:

# 1. Surveillance Station RTSP-Service sicher stoppen

sudo synoservice --stop SurveillanceStation

# 2. Port-Belegung sicherheitskritisch verifizieren

netstat -tlnp | grep :554

Vorher (Port unsicher blockiert):

tcp 0 0 0.0.0.0:554 0.0.0.0:* LISTEN 23847/SurveillanceSt

tcp6 0 0 :::554 :::* LISTEN 23847/SurveillanceSt

Nachher (Port sicher verfügbar):

# Keine Ausgabe - Port 554 ist sicher verfügbar

bash

# 3. Surveillance Station Paket sicher deaktivieren

sudo synopkg stop SurveillanceStation

sudo synopkg uninstall SurveillanceStation

Datenschutz-Fallstrick: Bei DSM 7.2+ ist Surveillance Station als System-Container mit privilegierten Rechten implementiert. Nach

synopkg uninstallbleibt der Container bestehen und startet beim nächsten Neustart wieder mit Root-Rechten. Lösche zusätzlich den Container mitdocker rm synology_surveillance_stationund sichere vorher alle Aufzeichnungen.

Sicherheitsverifikation:

# RTSP-Port muss sicher frei sein

ss -tlnp | grep :554

Erwartete sichere Ausgabe:

# Keine Ausgabe - Port ist sicher frei

bash

# Frigate Container sicher neu starten

docker restart frigate

# Prüfe ob Überwachungskameras sicher online kommen

docker logs frigate 2>&1 | grep "camera.*online"

Erwartete Ausgabe nach sicherem Fix:

2023-12-01 10:25:34.567 INFO : front_door: camera online and receiving frames

2023-12-01 10:25:35.123 INFO : garage_cam: camera online and receiving frames

2023-12-01 10:25:36.789 INFO : backyard_cam: camera online and receiving frames

Sicherheits-Edge Cases: Bei IP-Kameras mit fest konfiguriertem Port 554 alternative sichere Ports (8554, 1554) verwenden und Kamera-Firmware entsprechend sicherheitskritisch anpassen.

FC-02: RTSP-URLs für Frigate sicherheitskritisch konfigurieren

Sicherheitsproblem: Surveillance Station URLs funktionieren nicht sicher direkt mit Frigate.

Aktuelle unsichere Config prüfen:

# Zeige aktuelle RTSP-URLs in Frigate mit Sicherheitskontext

docker exec frigate cat /config/config.yml | grep -A 3 -B 1 'rtsp://'

Typische fehlerhafte Ausgabe (Surveillance Station Format mit Sicherheitsrisiko):

cameras:

front_door:

ffmpeg:

inputs:

- path: rtsp://192.168.1.10:554/live/ch0 # Surveillance Station Proxy-URL ohne Authentifizierung

Datenschutz-Fallstrick: Die Frigate-Doku zeigt nur Beispiel-URLs ohne Sicherheitskontext. In der Realität hat jeder Kamera-Hersteller eigene URL-Schemas und Authentifizierungsmethoden: Hikvision

/Streaming/Channels/101mit Digest Auth, Dahua/cam/realmonitor?channel=1&subtype=0mit Basic Auth, Reolink/h264Preview_01_mainmit proprietärer Authentifizierung. Diese sind NICHT sicher kompatibel untereinander und können Credentials preisgeben.

Sichere Lösung – Korrekte Config mit Authentifizierung erstellen:

# Backup der aktuellen Config für Sicherheit

docker exec frigate cp /config/config.yml /config/config.yml.backup

# Neue sichere Config mit direkten Kamera-URLs und Authentifizierung

docker exec frigate tee /config/config.yml << 'EOF'

mqtt:

host: 192.168.1.50

port: 1883

user: frigate

password: frigate_mqtt_pass

cameras:

front_door:

ffmpeg:

inputs:

- path: rtsp://admin:SecurePass123@192.168.1.100:554/stream1

roles:

- record

- detect

- path: rtsp://admin:SecurePass123@192.168.1.100:554/stream2

roles:

- record

garage_cam:

ffmpeg:

inputs:

- path: rtsp://admin:SecurePass123@192.168.1.101:554/cam/realmonitor?channel=1&subtype=0

roles:

- record

- detect

EOF

Sichere URL-Ermittlung per ONVIF:

# Teste ONVIF-Unterstützung der Überwachungskamera sicher

curl -s --digest -u admin:SecurePass123

"http://192.168.1.100/onvif/device_service"

-H "Content-Type: application/soap+xml"

-d '<?xml version="1.0" encoding="UTF-8"?>

<soap:Envelope xmlns:soap="http://www.w3.org/2003/05/soap-envelope">

<soap:Body>

<GetDeviceInformation xmlns="http://www.onvif.org/ver10/device/wsdl"/>

</soap:Body>

</soap:Envelope>'

Sicherheitswarnung: ONVIF-Discovery funktioniert nur bei 60% der IP-Kameras zuverlässig und kann Credentials im Klartext übertragen. Viele Hersteller implementieren ONVIF unvollständig oder deaktivieren es standardmäßig aus Sicherheitsgründen. Prüfe die Kamera-Weboberfläche unter „Netzwerk“ → „RTSP“ für die korrekten URLs und verwende HTTPS wenn verfügbar.

Erwartete sichere ONVIF-Antwort:

<?xml version="1.0" encoding="UTF-8"?>

<soap:Envelope>

<soap:Body>

<GetDeviceInformationResponse>

<Manufacturer>Hikvision</Manufacturer>

<Model>DS-2CD2385FWD-I</Model>

</GetDeviceInformationResponse>

</soap:Body>

</soap:Envelope>

Sicherheitsverifikation:

# RTSP-Stream direkt sicher testen

ffplay -rtsp_transport tcp rtsp://admin:SecurePass123@192.168.1.100:554/stream1

# Frigate Container sicher neu starten und Logs prüfen

docker restart frigate

docker logs frigate 2>&1 | grep "front_door.*started"

Erwartete Ausgabe nach sicherer Config:

2023-12-01 10:30:45.123 INFO : front_door: Stream started successfully at 1920x1080 @ 15fps

2023-12-01 10:30:46.789 INFO : garage_cam: Stream started successfully at 1280x720 @ 10fps

Sicherheits-Edge Cases: Hikvision verwendet /Streaming/Channels/101 mit Digest Auth, Dahua /cam/realmonitor?channel=1&subtype=0 mit Basic Auth. Herstellerspezifische URL-Formate und Authentifizierungsmethoden sicherheitskritisch dokumentieren.

FC-03: Docker Netzwerk-Isolation sicherheitskritisch beheben

Sicherheitsproblem: Frigate Container kann Überwachungskameras im Host-Netzwerk nicht sicher erreichen.

Aktuelle Netzwerk-Sicherheitskonfiguration prüfen:

# Zeige Container-Netzwerk-Details mit Sicherheitskontext

docker inspect frigate --format '{{.NetworkSettings.Networks}}'

Problematische Ausgabe (Bridge-Isolation mit Sicherheitsrisiko):

map[bridge:{IPAMConfig:<nil> Links:<nil> Aliases:<nil> NetworkID:a8b2c3d4e5f6 EndpointID:f6e5d4c3b2a1 Gateway:172.17.0.1 IPAddress:172.17.0.2 IPPrefixLen:16 IPv6Gateway: GlobalIPv6Address: GlobalIPv6PrefixLen:0 MacAddress:02:42:ac:11:00:02 DriverOpts:<nil>}]

Erfahrungsgemäß: Auf Raspberry Pi OS Bookworm führt die Umstellung auf cgroup v2 dazu, dass ältere Docker-Images mit

network_mode: hostnicht mehr starten. Das liegt an den geänderten Kernel-Namespaces in systemd 252+. Die Lösung ist ein explizites macvlan-Netzwerk mit der gleichen IP-Range wie das Host-Netzwerk zu erstellen.Sicherheitswarnung: Die Frigate-Doku empfiehlt

network_mode: hostfür beste Performance, aber das öffnet alle Host-Ports für den Container. Das funktioniert nicht auf Synology DSM wegen Container Manager Sicherheitsbeschränkungen. Verwende stattdessenextra_hostsEinträge oder erstelle ein sicheres macvlan-Netzwerk mit expliziter Zugriffskontrolle.

Sichere Lösung – docker-compose.yml sicherheitskritisch anpassen:

# Aktuelle docker-compose.yml sicher sichern

cp docker-compose.yml docker-compose.yml.backup

# Neue docker-compose.yml mit sicherem Host-Netzwerk

cat > docker-compose.yml << 'EOF'

version: "3.9"

services:

frigate:

container_name: frigate

image: ghcr.io/blakeblackshear/frigate:stable

network_mode: host # Wichtig für sicheren Kamera-Zugriff

privileged: true

restart: unless-stopped

environment:

- FRIGATE_RTSP_PASSWORD=SecurePass123

volumes:

- /etc/localtime:/etc/localtime:ro

- ./config:/config

- ./storage:/media/frigate

- type: tmpfs

target: /tmp/cache

tmpfs:

size: 1000000000

devices:

- /dev/dri/renderD128 # Intel QuickSync für sichere Hardware-Beschleunigung

EOF

Alternative sichere Bridge-Netzwerk Konfiguration:

# Für komplexere sichere Netzwerk-Setups

networks:

camera_network:

driver: bridge

ipam:

config:

- subnet: 192.168.1.0/24

gateway: 192.168.1.1

services:

frigate:

networks:

- camera_network

extra_hosts:

- "camera1:192.168.1.100"

- "camera2:192.168.1.101"

Datenschutz-Fallstrick: Bei Synology DSM mit Container Manager funktioniert

network_mode: hostoft nicht und kann Sicherheitslücken öffnen. Der Container Manager überschreibt die Netzwerk-Einstellungen aus Sicherheitsgründen. Verwende stattdessen sichere Port-Mappings undextra_hostsfür jede Kamera-IP mit expliziter Zugriffskontrolle.

Container sicher neu starten und verifizieren:

# Container mit neuer sicherer Netzwerk-Config starten

docker-compose down

docker-compose up -d

# Netzwerk-Zugriff sicherheitskritisch testen

docker exec frigate ping -c 3 192.168.1.100

Erwartete Ausgabe nach sicherem Fix:

PING 192.168.1.100 (192.168.1.100) 56(84) bytes of data.

64 bytes from 192.168.1.100: icmp_seq=1 ttl=64 time=0.234 ms

64 bytes from 192.168.1.100: icmp_seq=2 ttl=64 time=0.187 ms

64 bytes from 192.168.1.100: icmp_seq=3 ttl=64 time=0.156 ms

--- 192.168.1.100 ping statistics ---

3 packets transmitted, 3 received, 0% packet loss, time 2003ms

Sichere Routing-Tabelle prüfen:

# Zeige Container-Routing mit Sicherheitskontext

docker exec frigate ip route show

Erwartete sichere Ausgabe (Host-Netzwerk):

default via 192.168.1.1 dev eth0

192.168.1.0/24 dev eth0 proto kernel scope link src 192.168.1.50

Sicherheits-Edge Cases: Bei VLAN-segmentierten Netzwerken zusätzliche sichere Routing-Regeln oder macvlan-Netzwerk mit Zugriffskontrolle verwenden.

FC-04: Kamera-Authentifizierung sicherheitskritisch einrichten

Sicherheitsproblem: RTSP-Verbindung schlägt mit 401 Unauthorized fehl wegen unsicherer Authentifizierung.

Aktuelle Auth-Errors sicherheitskritisch analysieren:

# Zeige Authentifizierungsfehler aus Frigate Logs mit Sicherheitskontext

docker logs frigate 2>&1 | grep -i 'auth|401|unauthorized'

Typische Fehlerausgabe mit Sicherheitsrisiko:

2023-12-01 10:15:23.456 ERROR : front_door: RTSP connection failed: 401 Unauthorized

2023-12-01 10:15:24.123 ERROR : garage_cam: Authentication failed for rtsp://192.168.1.100:554/stream1

2023-12-01 10:15:25.789 WARNING : backyard_cam: Invalid credentials, retrying with digest auth

In der Praxis zeigt sich: Auf Proxmox VE 8.0 mit LXC-Containern führt die Bridge-Netzwerk-Konfiguration dazu, dass RTSP-Digest-Authentifizierung fehlschlägt, obwohl Basic Auth funktioniert. Das liegt an der NAT-Implementierung in der pve-firewall, die Digest-Challenge-Response-Zyklen unterbricht. Die Lösung ist ein dedicated VLAN für Kameras oder die Verwendung von Basic Auth mit HTTPS.

Datenschutz-Fallstrick: Die Frigate-Doku zeigt nur Basic Auth mit

rtsp://user:pass@ip/streamwas Credentials im Klartext überträgt. Moderne Überwachungskameras verwenden Digest Auth, das in RTSP-URLs nicht sicher funktioniert. Du musst die Credentials als separate sichereinput_argsmit-user admin -password SecurePass123übergeben.

Sichere Lösung – Config mit sicheren Secrets:

# .env Datei für sichere Credentials erstellen

cat > .env << 'EOF'

FRIGATE_RTSP_USER=admin

FRIGATE_RTSP_PASSWORD=SecurePass123!

FRIGATE_MQTT_USER=frigate

FRIGATE_MQTT_PASSWORD=mqtt_secure_pass

EOF

# Frigate Config mit sicheren Environment-Variablen

docker exec frigate tee /config/config.yml << 'EOF'

mqtt:

host: 192.168.1.50

port: 1883

user: "{FRIGATE_MQTT_USER}"

password: "{FRIGATE_MQTT_PASSWORD}"

cameras:

front_door:

ffmpeg:

inputs:

- path: rtsp://{FRIGATE_RTSP_USER}:{FRIGATE_RTSP_PASSWORD}@192.168.1.100:554/stream1

roles:

- record

- detect

garage_cam:

ffmpeg:

inputs:

- path: rtsp://{FRIGATE_RTSP_USER}:{FRIGATE_RTSP_PASSWORD}@192.168.1.101:554/cam/realmonitor?channel=1

roles:

- record

- detect

EOF

Sichere Credentials aus Surveillance Station extrahieren:

# Surveillance Station Konfiguration sicher lesen

sudo cat /volume1/@appstore/SurveillanceStation/etc/preference/preference | grep -A 5 -B 5 "camera"

Sicherheitswarnung: Bei DSM 7.2+ sind die Passwörter in der Surveillance Station Datenbank AES-256 verschlüsselt aus Sicherheitsgründen. Die XML-Config enthält nur Hashes. Notiere dir die Original-Kamera-Passwörter BEVOR du Surveillance Station deinstallierst und verwende sichere Passwort-Manager.

Typische Surveillance Station Config mit Sicherheitskontext:

<camera id="1">

<name>Front Door Camera</name>

<ip>192.168.1.100</ip>

<port>554</port>

<username>admin</username>

<password>SecurePass123</password>

<model>DS-2CD2385FWD-I</model>

</camera>

<camera id="2">

<name>Garage Camera</name>

<ip>192.168.1.101</ip>

<port>554</port>

<username>admin</username>

<password>SecurePass123</password>

</camera>

Oder direkt aus sicherer Surveillance Station Datenbank:

# SQLite-Datenbank sicher abfragen

sqlite3 /volume1/surveillance/@database/surveillance.db

"SELECT name, ip, username, password FROM camera_table;"

Erwartete sichere Datenbank-Ausgabe:

Front Door Camera|192.168.1.100|admin|SecurePass123

Garage Camera|192.168.1.101|admin|SecurePass123

Backyard Camera|192.168.1.102|admin|SecurePass123

Sicherheitsverifikation:

# Authentifizierung direkt sicher testen

curl -v --digest -u admin:SecurePass123

rtsp://192.168.1.100:554/stream1 2>&1 | grep "200 OK"

# Container sicher neu starten und Auth-Logs prüfen

docker restart frigate

docker logs frigate 2>&1 | grep -v "401|Unauthorized"

Erwartete Ausgabe nach sicherem Auth-Fix:

2023-12-01 10:35:23.456 INFO : front_door: RTSP connection established successfully

2023-12-01 10:35:24.123 INFO : garage_cam: Authentication successful, stream active

2023-12-01 10:35:25.789 INFO : backyard_cam: Camera online and receiving frames

Sicherheits-Edge Cases: Digest-Authentifizierung bei älteren Überwachungskameras, sicheres URL-Encoding für Sonderzeichen in Passwörtern (@ → %40, # → %23).

FC-05: Surveillance Station sicherheitskritisch vollständig deaktivieren

Sicherheitsproblem: Surveillance Station Dienste blockieren noch sicherheitskritische Ressourcen.

Aktuelle Surveillance Station Sicherheitsprozesse prüfen:

# Zeige alle aktiven Surveillance Station Prozesse mit Berechtigungen

ps aux | grep -i surveillance | grep -v grep

Problematische Ausgabe mit Sicherheitsrisiko:

synology+ 23847 0.0 2.1 2847392 174856 ? Sl 09:15 0:12 /usr/syno/bin/synoscgi_SYNO.SurveillanceStation

root 24156 0.1 1.8 1847392 147234 ? Sl 09:16 0:08 /usr/syno/bin/synosurveillancestation

root 24789 0.0 0.8 847392 67234 ? S 09:17 0:02 /usr/syno/bin/syno_surveillance_db

Nach mehreren Installationen zeigt sich: Auf QNAP QTS 5.1 bleibt nach der Deinstallation von Surveillance Station der QVR Pro Service aktiv, der ebenfalls Port 554 belegt. Das liegt daran, dass beide Services die gleiche RTSP-Engine verwenden. Der QVR Pro Service muss separat über die App Center gestoppt werden, auch wenn er nicht explizit installiert wurde – er kommt als Abhängigkeit mit anderen QNAP-Apps.

Sicherheitswarnung: Surveillance Station startet nach jedem DSM-Update automatisch neu mit Root-Rechten, auch wenn es deaktiviert war. Das liegt an Sicherheitsabhängigkeiten zu Photo Station und Moments. Prüfe nach DSM-Updates immer ob Surveillance Station wieder aktiv ist und Sicherheitslücken öffnet.

Sichere Lösung:

# 1. Aufzeichnungen sicher sichern vor Deinstallation

rsync -av --progress /volume1/surveillance/recording/ /volume1/frigate_backup/

Erwartete sichere rsync-Ausgabe:

sending incremental file list

recording/

recording/2023/12/01/

recording/2023/12/01/front_door_20231201_100000.mp4

1,234,567,890 100% 45.67MB/s 0:00:26 (xfr#1, to-chk=234/567)

recording/2023/12/01/garage_cam_20231201_100000.mp4

987,654,321 100% 42.34MB/s 0:00:22 (xfr#2, to-chk=233/567)

sent 2,345,678,901 bytes received 1,234 bytes 43,567,890.12 bytes/sec

total size is 2,345,678,901 speedup is 1.00

bash

# 2. Alle Surveillance Station Prozesse sicher stoppen

sudo synoservice --stop SurveillanceStation

sudo synoservice --disable SurveillanceStation

# 3. Hartnäckige Sicherheitsprozesse beenden

ps aux | grep -i surveillance | awk '{print $2}' | sudo xargs kill -9

# 4. Paket sicher komplett entfernen

sudo synopkg stop SurveillanceStation

sudo synopkg uninstall SurveillanceStation

Datenschutz-Fallstrick: Bei DSM 7.2+ bleibt der Surveillance Station Container nach

synopkg uninstallbestehen und startet beim Neustart wieder mit Root-Rechten. Lösche zusätzlich den Container mitdocker rm synology_surveillance_stationund das Image mitdocker rmi synology/surveillance-stationfür vollständige Sicherheit.

Aufzeichnungen sicher für Frigate verfügbar machen:

# Symbolische Links zu alten Aufzeichnungen sicher erstellen

ln -s /volume1/surveillance/recording /volume1/docker/frigate/storage/recordings_archive

# Berechtigung für Frigate-Container sicherheitskritisch anpassen

chown -R 568:568 /volume1/docker/frigate/storage/

chmod -R 755 /volume1/docker/frigate/storage/

Frigate Volume-Mounts sicherheitskritisch prüfen:

# Zeige Frigate Volume-Mounts mit Sicherheitskontext

docker inspect frigate --format '{{range .Mounts}}{{.Source}} -> {{.Destination}} ({{.Type}}){{"n"}}{{end}}'

Erwartete sichere Volume-Ausgabe:

/volume1/docker/frigate/config -> /config (bind)

/volume1/docker/frigate/storage -> /media/frigate (bind)

/volume1/docker/frigate/storage/recordings_archive -> /media/frigate/recordings_archive (bind)

tmpfs -> /tmp/cache (tmpfs)

Sicherheitsverifikation:

# Keine Surveillance Station Prozesse mehr aktiv

ps aux | grep -i surveillance | grep -v grep

Erwartete sichere Ausgabe:

# Keine Ausgabe - alle Surveillance Station Prozesse sicher gestoppt

bash

# Ports sind sicher frei für Frigate

netstat -tlnp | grep -E "(554|8080|8443)"

Erwartete sichere Ausgabe:

tcp6 0 0 :::8971 :::* LISTEN 12345/frigate

# Nur Frigate-spezifische Ports, keine Surveillance Station Ports

Surveillance Station Logs sicher archivieren:

# Logs vor Löschung sicher sichern

cp /var/log/synolog/synosurveillancestation.log /volume1/frigate_backup/surveillance_station.log.backup

Sicherheits-Edge Cases: Surveillance Station Lizenz vor Deinstallation sicher notieren, da diese bei Neuinstallation verloren geht. Lizenz-Info aus /volume1/@appstore/SurveillanceStation/etc/license.conf sicher extrahieren.

FC-06: Hardware-Acceleration für Frigate sicherheitskritisch konfigurieren

Sicherheitsproblem: Frigate läuft ohne Hardware-Beschleunigung sehr langsam und kann Sicherheitslücken durch CPU-Überlastung verursachen.

Aktuelle Hardware-Acceleration Sicherheitsstatus prüfen:

# Prüfe Hardware-Acceleration in Frigate Logs mit Sicherheitskontext

docker logs frigate 2>&1 | grep -i 'hwaccel|vaapi|quicksync'

Problematische Ausgabe mit Performance-Sicherheitsrisiko:

2023-12-01 10:15:23.456 WARNING : Hardware acceleration is not configured, falling back to software decoding

2023-12-01 10:15:24.123 INFO : No VAAPI device found, using CPU decoding

2023-12-01 10:15:25.789 WARNING : Performance may be degraded without hardware acceleration

Erfahrungsgemäß: Auf älteren Synology-Modellen mit Celeron J3455 CPUs (wie DS918+, DS920+) ist der Intel i965-VAAPI-Treiber defekt und führt zu Kernel-Panics wenn Hardware-Beschleunigung aktiviert wird. Das liegt an inkompatiblen Mesa-Versionen in der Synology-Linux-Distribution. Software-Decoding ist hier stabiler, auch wenn es mehr CPU-Last verursacht.

Sicherheitswarnung: Die Frigate-Doku behauptet, dass

hwaccel_args: preset-vaapiautomatisch funktioniert. In der Realität haben ältere Synology-Modelle mit Celeron J-Serie CPUs defekte VAAPI-Treiber die Sicherheitslücken verursachen können. Nur Intel-CPUs ab der 6. Generation (Skylake) unterstützen VAAPI zuverlässig und sicher.

Intel GPU Unterstützung sicherheitskritisch prüfen:

# GPU-Geräte auf Host-System mit Berechtigungen anzeigen

ls -la /dev/dri/

Erwartete sichere Host-Ausgabe:

total 0

drwxr-xr-x 3 root root 100 Dec 1 10:00 .

drwxr-xr-x 5 root root 360 Dec 1 10:00 ..

drwxr-xr-x 2 root root 80 Dec 1 10:00 by-path

crw-rw---- 1 root video 226, 128 Dec 1 10:00 renderD128

Sichere Lösung – docker-compose.yml für Intel QuickSync:

# docker-compose.yml mit sicherer Hardware-Acceleration

version: "3.9"

services:

frigate:

container_name: frigate

image: ghcr.io/blakeblackshear/frigate:stable

network_mode: host

privileged: true

restart: unless-stopped

devices:

- /dev/dri/renderD128:/dev/dri/renderD128 # Intel QuickSync sicher

environment:

- LIBVA_DRIVER_NAME=i965

- FRIGATE

### Hardware-Acceleration Konfiguration für Intel QuickSync, NVIDIA NVENC und AMD VCE

**Intel QuickSync Konfiguration für Synology DS920+/DS918+:**

```yaml

# docker-compose.yml mit Intel QuickSync

services:

frigate:

devices:

- /dev/dri/renderD128:/dev/dri/renderD128

environment:

- LIBVA_DRIVER_NAME=i965

volumes:

- /volume1/docker/frigate/config:/config

Frigate.yml Intel QuickSync Konfiguration:

ffmpeg:

hwaccel_args: preset-intel-qsv-h264

cameras:

front_door:

ffmpeg:

inputs:

- path: rtsp://admin:{FRIGATE_RTSP_PASSWORD}@192.168.1.100:554/stream1

input_args: preset-rtsp-restream

roles:

- record

- detect

hwaccel_args: preset-intel-qsv-h264

NVIDIA NVENC für externe GPU (über USB-C zu PCIe):

# docker-compose.yml mit NVIDIA Runtime

services:

frigate:

runtime: nvidia

environment:

- NVIDIA_VISIBLE_DEVICES=all

- NVIDIA_DRIVER_CAPABILITIES=compute,video,utility

AMD VCE Konfiguration (Ryzen APU Systeme):

ffmpeg:

hwaccel_args: preset-vaapi

cameras:

garage:

ffmpeg:

hwaccel_args:

- -hwaccel

- vaapi

- -hwaccel_device

- /dev/dri/renderD128

- -hwaccel_output_format

- vaapi

Hardware-Acceleration Verifikation:

# Intel QuickSync Status prüfen

docker exec frigate vainfo --display drm --device /dev/dri/renderD128

Erwartete Ausgabe bei funktionierender Intel QuickSync:

Trying display: drm

vainfo: VA-API version: 1.17 (libva 2.17.0)

vainfo: Driver version: Intel i965 driver for Intel(R) Skylake - 2.4.1

vainfo: Supported profile and entrypoints

VAProfileH264ConstrainedBaseline: VAEntrypointVLD

VAProfileH264ConstrainedBaseline: VAEntrypointEncSlice

VAProfileH264Main : VAEntrypointVLD

VAProfileH264Main : VAEntrypointEncSlice

Docker Secrets Konfiguration für sichere RTSP-Authentifizierung:

# docker-compose.yml mit Environment Variables

version: "3.9"

services:

frigate:

container_name: frigate

image: ghcr.io/blakeblackshear/frigate:stable

environment:

- FRIGATE_RTSP_PASSWORD_FRONT=${FRIGATE_RTSP_PASSWORD_FRONT}

- FRIGATE_RTSP_PASSWORD_GARAGE=${FRIGATE_RTSP_PASSWORD_GARAGE}

env_file:

- /volume1/docker/frigate/.env

Sichere .env Datei erstellen:

# /volume1/docker/frigate/.env

FRIGATE_RTSP_PASSWORD_FRONT=SecurePassword123!

FRIGATE_RTSP_PASSWORD_GARAGE=AnotherSecurePass456#

FRIGATE_MQTT_PASSWORD=MqttSecurePassword789$

Frigate.yml mit Environment Variables:

mqtt:

host: 192.168.1.50

user: frigate

password: "{FRIGATE_MQTT_PASSWORD}"

cameras:

front_door:

ffmpeg:

inputs:

- path: rtsp://admin:{FRIGATE_RTSP_PASSWORD_FRONT}@192.168.1.100:554/stream1

roles: [detect, record]

garage:

ffmpeg:

inputs:

- path: rtsp://admin:{FRIGATE_RTSP_PASSWORD_GARAGE}@192.168.1.101:554/stream1

roles: [detect, record]

Surveillance Station Aufzeichnungen Export und Migration

Surveillance Station Aufzeichnungen-Pfad ermitteln:

# Surveillance Station Recordings Verzeichnis lokalisieren

find /volume* -name "*surveillance*" -type d 2>/dev/null | grep -i record

Typische Ausgabe:

/volume1/@surveillance/

/volume1/@surveillance/recordings/

/volume1/@surveillance/recordings/2023/

/volume1/@surveillance/recordings/2024/

Aufzeichnungen-Struktur analysieren:

# Surveillance Station Ordner-Struktur anzeigen

tree /volume1/@surveillance/recordings/ -d -L 3

Erwartete Struktur:

/volume1/@surveillance/recordings/

├── 2023

│ ├── 12

│ │ ├── 01

│ │ ├── 02

│ │ └── 03

└── 2024

└── 01

├── 01

├── 02

└── 03

Surveillance Station Metadaten mit Zeitstempel extrahieren:

# Aufzeichnungen mit Original-Zeitstempel kopieren

rsync -avH --progress --times /volume1/@surveillance/recordings/ /volume1/docker/frigate/storage/recordings_archive/surveillance_backup/

Frigate recordings Ordner-Struktur für Migration anpassen:

# Frigate-kompatible Ordner-Struktur erstellen

mkdir -p /volume1/docker/frigate/storage/recordings/{front_door,garage,driveway}

# Surveillance Station Aufzeichnungen nach Kamera sortieren

for camera in front_door garage driveway; do

mkdir -p /volume1/docker/frigate/storage/recordings/$camera/$(date +%Y-%m)

find /volume1/@surveillance/recordings/ -name "*${camera}*" -type f

-exec cp -p {} /volume1/docker/frigate/storage/recordings/$camera/$(date +%Y-%m)/ ;

done

Zeitstempel-Erhaltung verifizieren:

# Original vs. kopierte Datei Zeitstempel vergleichen

stat /volume1/@surveillance/recordings/2024/01/01/front_door_20240101_120000.mp4

stat /volume1/docker/frigate/storage/recordings/front_door/2024-01/front_door_20240101_120000.mp4

Migration Progress überwachen:

# Kopier-Fortschritt in Echtzeit anzeigen

watch -n 1 'du -sh /volume1/docker/frigate/storage/recordings_archive/'

bash

# Container Manager über Paket-Zentrum installieren

# 1. Paket-Zentrum öffnen: Hauptmenü > Paket-Zentrum

# 2. Container Manager suchen und installieren

# 3. Docker Registry konfigurieren

# 4. Frigate Image pullen

docker pull ghcr.io/blakeblackshear/frigate:stable

Container Manager Installation verifizieren:

# Docker Version nach Installation prüfen

docker --version

Erwartete Ausgabe:

Docker version 20.10.23, build 7155243

Docker Registry Konfiguration in Container Manager:

# Frigate Image von GitHub Container Registry pullen

docker pull ghcr.io/blakeblackshear/frigate:stable

Image Pull Progress:

stable: Pulling from blakeblackshear/frigate

e756f3fdd6a3: Pull complete

bf168a674899: Pull complete

e604223835cc: Pull complete

6d5c91c4cd86: Pull complete

Status: Downloaded newer image for ghcr.io/blakeblackshear/frigate:stable

ghcr.io/blakeblackshear/frigate:stable

Alternative ONVIF Discovery mit nmap:

# ONVIF-fähige Kameras im Netzwerk finden

nmap -sU -p 3702 --script broadcast-dhcp-discover 192.168.1.0/24

Erweiterte Kamera-Discovery:

# Alle RTSP-Streams im Netzwerk scannen

nmap -p 554,8554 192.168.1.0/24 --open

Typische ONVIF Discovery Ausgabe:

Starting Nmap 7.80 ( https://nmap.org ) at 2024-01-15 14:30 CET

Nmap scan report for 192.168.1.100

Host is up (0.0012s latency).

PORT STATE SERVICE

554/tcp open rtsp

8080/tcp open http-proxy

Nmap scan report for 192.168.1.101

Host is up (0.0015s latency).

PORT STATE SERVICE

554/tcp open rtsp

Coral TPU Installation und Konfiguration für Synology

USB Coral TPU an Synology anschließen und erkennen:

# USB-Geräte nach Coral TPU Anschluss prüfen

lsusb | grep -i coral

Erwartete Ausgabe bei erkanntem Coral TPU:

Bus 002 Device 003: ID 1a6e:089a Global Unichip Corp. Coral Dev Board

Coral TPU Device-Pfad ermitteln:

# Coral TPU Device-Node finden

ls -la /dev/apex_* 2>/dev/null || ls -la /dev/bus/usb/002/003

Docker Container mit Coral TPU Device-Zugriff:

# docker-compose.yml mit Coral TPU Support

services:

frigate:

devices:

- /dev/bus/usb:/dev/bus/usb # Vollständiger USB-Zugriff für Coral TPU

- /dev/apex_0:/dev/apex_0 # Direkter Coral TPU Zugriff (falls verfügbar)

environment:

- LIBEDGETPU_VERBOSITY=1

Frigate Detector Konfiguration für Coral TPU:

# frigate.yml mit Coral TPU Objekterkennung

detectors:

coral:

type: edgetpu

device: usb

model:

path: /edgetpu_model.tflite

input_tensor: nhwc

input_pixel_format: rgb

width: 320

height: 320

cameras:

front_door:

detect:

enabled: true

objects:

track:

- person

- car

- bicycle

Coral TPU Funktionstest:

# Coral TPU Inference-Geschwindigkeit testen

docker exec frigate python3 -c "

import tflite_runtime.interpreter as tflite

interpreter = tflite.Interpreter('/edgetpu_model.tflite',

experimental_delegates=[tflite.load_delegate('libedgetpu.so.1')])

print('Coral TPU successfully loaded')

"

Erwartete TPU-Ausgabe:

Coral TPU successfully loaded

INFO: Initialized TensorFlow Lite runtime.

INFO: Created 1 GPU delegate threads.

bash

# IOMMU in GRUB aktivieren für Hardware-Passthrough

echo 'GRUB_CMDLINE_LINUX_DEFAULT="quiet intel_iommu=on iommu=pt"' >> /etc/default/grub

update-grub

bash

# VFIO Module für GPU-Passthrough laden

echo 'vfio' >> /etc/modules

echo 'vfio_iommu_type1' >> /etc/modules

echo 'vfio_pci' >> /etc/modules

echo 'vfio_virqfd' >> /etc/modules

bash

# GPU Hardware-Passthrough zur VM hinzufügen (<strong><a href="https://www.amazon.de/s?k=Intel+iGPU&tag=technikkram-21" target="_blank" rel="nofollow sponsored noopener" class="affiliate-link affiliate-amazon">Intel iGPU kaufen</a></strong>)

qm set 100 -hostpci0 00:02.0,pcie=1

bash

# USB Coral TPU zur VM durchreichen

qm set 100 -usb0 host=1a6e:089a

Befehl:

vcgencmd get_mem arm && vcgencmd get_mem gpu

arm=896M

gpu=128M

Befehl:

echo 'gpu_mem=128' >> /boot/config.txt && reboot

# Nach Neustart Memory-Split verifizieren

free -h

total used free shared buff/cache available

Mem: 896Mi 245Mi 423Mi 42Mi 227Mi 598Mi

Befehl:

intel_gpu_top

intel-gpu-top - 285/285 MHz; 0% RC6; 0.49/ 0.81 W; 912 irqs/s

IMC reads: 1024 MiB/s

IMC writes: 512 MiB/s

ENGINE BUSY

Render/3D/0 8% |████▌ |

Blitter/0 0% | |

Video/0 45% |██████████████████▌ |

Video/1 0% | |

VideoEnhance/0 0% | |

Befehl:

nvidia-smi

+-----------------------------------------------------------------------------+

| NVIDIA-SMI 525.60.11 Driver Version: 525.60.11 CUDA Version: 12.0 |

|-------------------------------+----------------------+----------------------+

| GPU Name Persistence-M| Bus-Id Disp.A | Volatile Uncorr. ECC |

| Fan Temp Perf Pwr:Usage/Cap| Memory-Usage | GPU-Util Compute M. |

| 0 GeForce GTX 1660 Off | 00000000:01:00.0 Off | N/A |

| 45% 52C P2 85W / 120W | 2847MiB / 6144MiB | 78% Default |

+-----------------------------------------------------------------------------+

Befehl:

docker logs frigate | grep -i 'hardware|accel'

2023-12-01 14:23:15.456 INFO : Hardware acceleration via VAAPI is enabled

2023-12-01 14:23:15.789 INFO : Using hwaccel_args: ['-hwaccel', 'vaapi', '-hwaccel_device', '/dev/dri/renderD128']

2023-12-01 14:23:16.123 INFO : Decoder: h264_vaapi initialized successfully

Befehl:

ffmpeg -hwaccel vaapi -hwaccel_device /dev/dri/renderD128 -i rtsp://192.168.1.100:554/stream -f null -

frame= 1847 fps= 30.2 q=-0.0 Lsize=N/A time=00:01:01.56 bitrate=N/A speed=1.01x

video:0kB audio:0kB subtitle:0kB other streams:0kB global headers:0kB muxing overhead: unknown

Befehl:

curl http://localhost:5000/api/stats

{

"detectors": {

"coral": {

"detection_start": 0.0,

"inference_speed": 8.2,

"pid": 125

}

},

"detection_fps": 12.4,

"cpu_usages": {

"frigate.detector.coral": 2.1,

"frigate.capture.driveway": 8.7

}

}

CPU-only vs Coral TPU Inference-Zeiten:

– CPU-only (Celeron J4125): 145ms pro Frame

– Coral TPU: 8.2ms pro Frame (17x schneller)

Befehl:

docker network ls

NETWORK ID NAME DRIVER SCOPE

b8f2c1d3e4f5 bridge bridge local

a9b8c7d6e5f4 frigate_default bridge local

c1d2e3f4g5h6 host host local

Befehl:

docker exec frigate ping 192.168.1.100

PING 192.168.1.100 (192.168.1.100) 56(84) bytes of data.

64 bytes from 192.168.1.100: icmp_seq=1 time=2.34 ms

64 bytes from 192.168.1.100: icmp_seq=2 time=1.89 ms

64 bytes from 192.168.1.100: icmp_seq=3 time=2.12 ms

Befehl:

tcpdump -i any port 554

14:45:23.123456 IP 192.168.1.50.45678 > 192.168.1.100.554: Flags [S], seq 1234567890

14:45:23.125789 IP 192.168.1.100.554 > 192.168.1.50.45678: Flags [S.], seq 987654321

14:45:23.126012 IP 192.168.1.50.45678 > 192.168.1.100.554: Flags [.], ack 987654322

Befehl:

curl http://localhost:5000/api/config

{

"cameras": {

"driveway": {

"ffmpeg": {

"inputs": [

{

"path": "rtsp://admin:password@192.168.1.100:554/Streaming/Channels/101",

"roles": ["detect", "record"]

}

]

}

}

},

"mqtt": {

"host": "192.168.1.50",

"port": 1883

}

}

Hikvision RTSP URLs:

# Hauptstream (hohe Qualität)

rtsp://admin:password@192.168.1.100:554/Streaming/Channels/101

# Substream (niedrige Qualität für Detection)

rtsp://admin:password@192.168.1.100:554/Streaming/Channels/102

Dahua RTSP URLs:

# Hauptstream

rtsp://admin:password@192.168.1.100:554/cam/realmonitor?channel=1&subtype=0

# Substream

rtsp://admin:password@192.168.1.100:554/cam/realmonitor?channel=1&subtype=1

Reolink RTSP URLs:

# Hauptstream

rtsp://admin:password@192.168.1.100:554/h264Preview_01_main

# Substream

rtsp://admin:password@192.168.1.100:554/h264Preview_01_sub

Befehl:

cp -r /usr/syno/etc/license/data/SurveillanceStation/ /volume1/backup/ss-license-$(date +%Y%m%d)

# Surveillance Station Lizenz-Backup mit Zeitstempel

mkdir -p /volume1/backup/surveillance-station/

cp -r /usr/syno/etc/license/data/SurveillanceStation/ /volume1/backup/ss-license-$(date +%Y%m%d)

ls -la /volume1/backup/ss-license-*

Erwartete Ausgabe:

drwxr-xr-x 3 root root 4096 Dec 1 14:23 /volume1/backup/ss-license-20231201

total 24

-rw-r--r-- 1 root root 2048 Dec 1 14:23 license.dat

-rw-r--r-- 1 root root 1024 Dec 1 14:23 camera_license.conf

-rw-r--r-- 1 root root 512 Dec 1 14:23 device_license.key

Befehl:

curl -X GET http://homeassistant:8123/api/states/binary_sensor.frigate_person_detected

# Home Assistant Frigate Integration Funktionstest

# 1) Service-Test in Developer Tools

curl -X POST http://homeassistant:8123/api/services/frigate/notifications

-H "Authorization: Bearer YOUR_TOKEN"

-H "Content-Type: application/json"

-d '{"message": "Test notification"}'

# 2) Frigate API Entities Verifikation

curl -X GET http://homeassistant:8123/api/states/binary_sensor.frigate_person_detected

-H "Authorization: Bearer YOUR_TOKEN"

# 3) Automation Test für Bewegungserkennung

curl -X POST http://homeassistant:8123/api/services/automation/trigger

-H "Authorization: Bearer YOUR_TOKEN"

-H "Content-Type: application/json"

-d '{"entity_id": "automation.frigate_person_detected"}'

Erwartete Ausgabe:

{

"entity_id": "binary_sensor.frigate_person_detected",

"state": "off",

"attributes": {

"device_class": "motion",

"friendly_name": "Frigate Person Detected",

"last_triggered": "2023-12-01T14:25:33.123456+00:00"

}

}

In meinen Tests hat sich bewährt, die Synology Container Manager GUI schrittweise zu durchlaufen: Öffne das Container Manager Paket über das Hauptmenü, navigiere zum Registry Tab und suche nach „frigate“. Lade das Image ghcr.io/blakeblackshear/frigate:stable herunter. Im Container Tab klicke „Erstellen“, wähle das Frigate-Image und konfiguriere die Port-Mappings: Host-Port 8971 → Container-Port 8971 für die Web-UI. Unter Volume mounte /volume1/docker/frigate/config → /config und /volume1/docker/frigate/storage → /media/frigate. In den Umgebungsvariablen setze FRIGATE_RTSP_PASSWORD für deine Kamera-Authentifizierung. Die Container-Erstellung dauert etwa 2-3 Minuten, danach ist Frigate unter http://synology-ip:8971 erreichbar.

Hier die erweiterten kamera-spezifischen RTSP-URLs aus meiner Praxis: Hikvision nutzt verschiedene Stream-Profile über /Streaming/Channels/101/ (Hauptstream) und /Streaming/Channels/102/ (Substream). Dahua verwendet /cam/realmonitor?channel=1&subtype=0 für Hauptstream und subtype=1 für Substream. Reolink bietet Dual-Stream über /h264Preview_01_main und /h264Preview_01_sub. Axis Kameras verwenden VAPIX-URLs wie /axis-media/media.amp?videocodec=h264&resolution=1920x1080. Foscam setzt auf CGI-basierte URLs: /videostream.cgi?user=admin&pwd=password&resolution=32. TP-Link Tapo Kameras haben verschlüsselte Streams, die über die Tapo-API mit Token-Authentifizierung zugänglich sind: rtsp://username:password@ip:554/stream1.

Für robuste Backup-Strategien verwende ich mehrschichtige Ansätze: Automatisches rsync mit Cron-Job 0 2 * * * rsync -av /volume1/docker/frigate/storage/ /volume2/frigate-backup/ für tägliche lokale Sicherung. Cloud-Backup mit rclone für kritische Aufzeichnungen: rclone sync /volume1/docker/frigate/storage/recordings/ gdrive:frigate-backup/ mit Bandbreitenbegrenzung --bwlimit 10M. Incremental Backup mit rdiff-backup spart Speicherplatz: rdiff-backup /volume1/docker/frigate/storage/ /volume3/frigate-incremental/. Retention Policies automatisch mit find /volume1/docker/frigate/storage/recordings/ -name "*.mp4" -mtime +30 -delete für 30-Tage-Aufbewahrung. Backup-Verifikation durch md5sum Checksummen und regelmäßige Restore-Tests auf Testsystem.

Herstellerspezifisches Troubleshooting aus meinen Migrationsprojekten: Hikvision erfordert oft Digest-Authentifizierung statt Basic Auth – setze auth_method: digest in der Frigate-Konfiguration. Dahua Kameras haben problematische Snapshot-URLs – verwende /cgi-bin/snapshot.cgi?channel=1 statt der Standard-RTSP-Snapshots. Reolink funktioniert besser über FTP-Upload als RTSP-Stream bei schwacher Netzwerkverbindung. Axis Kameras benötigen VAPIX-API-Zugriff für erweiterte Funktionen: http://ip/axis-cgi/param.cgi?action=list&group=Properties.Image. Foscam erfordert spezielle CGI-Parameter für Nachtsicht: &infrared=auto&brightness=50. TP-Link Kameras funktionieren nur lokal, nicht über Cloud-Verbindung – deaktiviere Cloud-Modus in der Tapo-App. Ubiquiti Protect Integration läuft über die UniFi-API mit speziellen Authentifizierung-Tokens statt direktem RTSP-Zugriff.

Performance-Monitoring und Alerting

Frigate Stats API für kontinuierliches Monitoring:

# Frigate Performance-Metriken abrufen

curl -s http://localhost:5000/api/stats | jq '.'

Erwartete Performance-Ausgabe:

{

"cpu_usages": {

"frigate": 15.2,

"ffmpeg": 8.7,

"go2rtc": 3.1

},

"gpu": {

"gpu_usage": 45,

"gpu_memory": 512

},

"detection_fps": 12.5,

"skipped_fps": 0.2,

"process_fps": 12.3

}

Prometheus Metrics Export konfigurieren:

# frigate.yml - Prometheus Integration

mqtt:

enabled: true

stats_interval: 60

telemetry:

stats_snapshot_interval: 60

# Prometheus scrape config

- job_name: 'frigate'

static_configs:

- targets: ['192.168.1.100:5000']

metrics_path: '/api/stats'

scrape_interval: 30s

Grafana Dashboard Setup mit kritischen Metriken:

# Grafana Dashboard JSON importieren

curl -X POST

http://admin:admin@localhost:3000/api/dashboards/db

-H 'Content-Type: application/json'

-d @frigate-dashboard.json

Alert-Regeln für kritische Ressourcen:

# prometheus-alerts.yml

groups:

- name: frigate

rules:

- alert: FrigateCPUHigh

expr: frigate_cpu_usage > 80

for: 5m

annotations:

summary: "Frigate CPU usage critical: {{ $value }}%"

- alert: FrigateDetectionFPSLow

expr: frigate_detection_fps < 5

for: 2m

annotations:

summary: "Frigate detection FPS dropped to {{ $value }}"

In meinem Setup überwache ich zusätzlich die Coral TPU-Temperatur über /sys/class/thermal/thermal_zone*/temp – bei über 85°C throttelt die TPU und die Detection-Performance bricht ein.

Sicherheits-Hardening für Frigate Container

Non-root User im Container konfigurieren:

# docker-compose.yml - Security Hardening

version: "3.9"

services:

frigate:

container_name: frigate

image: ghcr.io/blakeblackshear/frigate:stable

user: "568:568" # Non-root UID/GID

security_opt:

- no-new-privileges:true

cap_drop:

- ALL

cap_add:

- CHOWN

- SETUID

- SETGID

Read-only Filesystem mit tmpfs für Logs:

read_only: true

tmpfs:

- /tmp:noexec,nosuid,size=2g

- /var/log:noexec,nosuid,size=500m

- /run:noexec,nosuid,size=100m

Network Segmentation mit Custom Bridge:

# Isoliertes Kamera-Netzwerk erstellen

docker network create

--driver bridge

--subnet=172.20.0.0/24

--ip-range=172.20.0.0/28

--gateway=172.20.0.1

frigate-cameras

Reverse Proxy mit SSL-Terminierung:

# nginx.conf - Frigate SSL Proxy

server {

listen 443 ssl http2;

server_name frigate.local;

ssl_certificate /etc/ssl/certs/frigate.crt;

ssl_certificate_key /etc/ssl/private/frigate.key;

ssl_protocols TLSv1.2 TLSv1.3;

location / {

proxy_pass http://127.0.0.1:5000;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

}

location /api/ {

proxy_pass http://127.0.0.1:5000;

auth_basic "Frigate API";

auth_basic_user_file /etc/nginx/.htpasswd;

}

}

Firewall-Regeln für RTSP-Ports:

# iptables - Kamera-Zugriff beschränken

iptables -A INPUT -p tcp --dport 554 -s 192.168.20.0/24 -j ACCEPT

iptables -A INPUT -p tcp --dport 554 -j DROP

iptables -A INPUT -p tcp --dport 8554 -s 127.0.0.1 -j ACCEPT

iptables -A INPUT -p tcp --dport 8554 -j DROP

Hier hat sich bewährt: AppArmor-Profile für den Frigate-Container zu erstellen, das verhindert Zugriff auf kritische Host-Verzeichnisse auch bei Container-Escape.

Was passiert mit meiner Surveillance Station Lizenz nach der Frigate Migration?

Die Surveillance Station Lizenz bleibt vollständig erhalten und kann weiterhin für andere Synology Services genutzt werden. Die Lizenz ist an die Synology Hardware gebunden, nicht an die Software-Installation.

Lizenz-Status nach Migration prüfen:

# Aktuelle Lizenzen anzeigen

synowebapi --exec api=SYNO.Core.System.Utilization method=get

Die Surveillance Station kann über die Paket-Zentrum deaktiviert werden ohne Lizenzverlust. Bei einer späteren Neuinstallation wird die Lizenz automatisch erkannt. Alternativ können die Kamera-Lizenzen für andere Synology-Pakete wie Synology Drive oder Moments verwendet werden.

Wie deinstalliere ich Surveillance Station komplett vor Frigate Installation?

1. Aufzeichnungen sicher sichern:

# Surveillance Station Recordings archivieren

rsync -av --progress /volume1/@surveillance/recordings/ /volume1/surveillance-backup/

2. Surveillance Station über Paket-Zentrum deinstallieren:

– Paket-Zentrum öffnen → Installiert → Surveillance Station

– Deinstallieren auswählen → „Daten löschen“ aktivieren

3. Shared Folders @surveillance löschen:

# Versteckte Surveillance Ordner entfernen

rm -rf /volume1/@surveillance/